Capítulo 3 Deriva genética

En el capítulo anterior (Variación y equilibrio de Hardy-Weinberg) comenzamos a entender los procesos que hay por detrás del mantenimiento de la variabilidad genética en las poblaciones de distintas especies. En particular, a partir de las reglas mecanísticas de la herencia mendeliana32 vimos que una vez alcanzado el equilibrio, si no aparecen otras fuerzas, las frecuencias alélicas y genotípicas se mantienen constantes generación tras generación. Para esto hemos asumido varias cosas (Supuestos que asumimos se cumplen para H-W), algunas más razonables que otras. En particular, una de las cosas que asumimos es que el tamaño de nuestra población es prácticamente infinito (con esto queremos decir un número realmente muy alto de individuos), una situación que no siempre se cumple en la práctica. Más aún, esto nos lleva al concepto de población en nuestro contexto: el conjunto de individuos que potencialmente podrían aparearse en igualdad de condiciones con cualquier otro de la misma población para dejar descendencia fértil. Se trata de un concepto fácil de comprender, pero en la práctica suele ser bastante más complejo delimitar sus alcances. Pensemos, por ejemplo, en las poblaciones de Corriedale (ovinos), Angus (bovino de carne) o de Holando (bovino de leche) del Uruguay. ¿Se cumplen los supuestos del equilibrio de Hardy-Weinberg?. ¿Cuál sería mi población si el rebaño o rodeo es cerrado (i.e., produce sus propios reemplazos)?.

Habiendo definido en forma operativa lo que consideramos una población, rápidamente podemos llegar a ver que en muchas poblaciones asumir un tamaño casi infinito para las mismas es algo absurdo. Veremos que en las poblaciones donde se deja de lado esta asunción empieza a jugar una de las fuerzas siempre presentes en biología: el azar.

OBJETIVOS DEL CAPÍTULO

\(\square\) Comprender como el azar puede ser una fuerza evolutiva de relevancia en poblaciones de tamaño finito.

\(\square\) Modelar este fenómeno a través de modelos matemáticos; esto nos permitirá derivar predicciones respecto a qué se espera de la evolución de las frecuencias alélicas en un conjunto de poblaciones iguales. En particular, veremos el modelo de Wright-Fisher y la aplicación de cadenas de Markov en este problema.

\(\square\) Describir la evolución de la homocigosidad en poblaciones de tamaño finito conforme pasan las generaciones. Se presentará al coeficiente de fijación, y su tendencia según el modelo de Wright-Fisher.

\(\square\) Presentar el concepto de tamaño poblacional efectivo, el cual permite tratar a una población que se desvía de lo ideal con las herramientas matemáticas presentadas hasta ahora en dinstintos contextos biológicos.

\(\square\) Ver la aproximación por difusión, una herramienta matemática que permite integrar los procesos azarosos de cambio en las frecuencias alélicas con los procesos direccionados. Este modelado conjunto es más realista, en tanto en las poblaciones naturales es de esperar que los dos fenómenos tengan influencia.

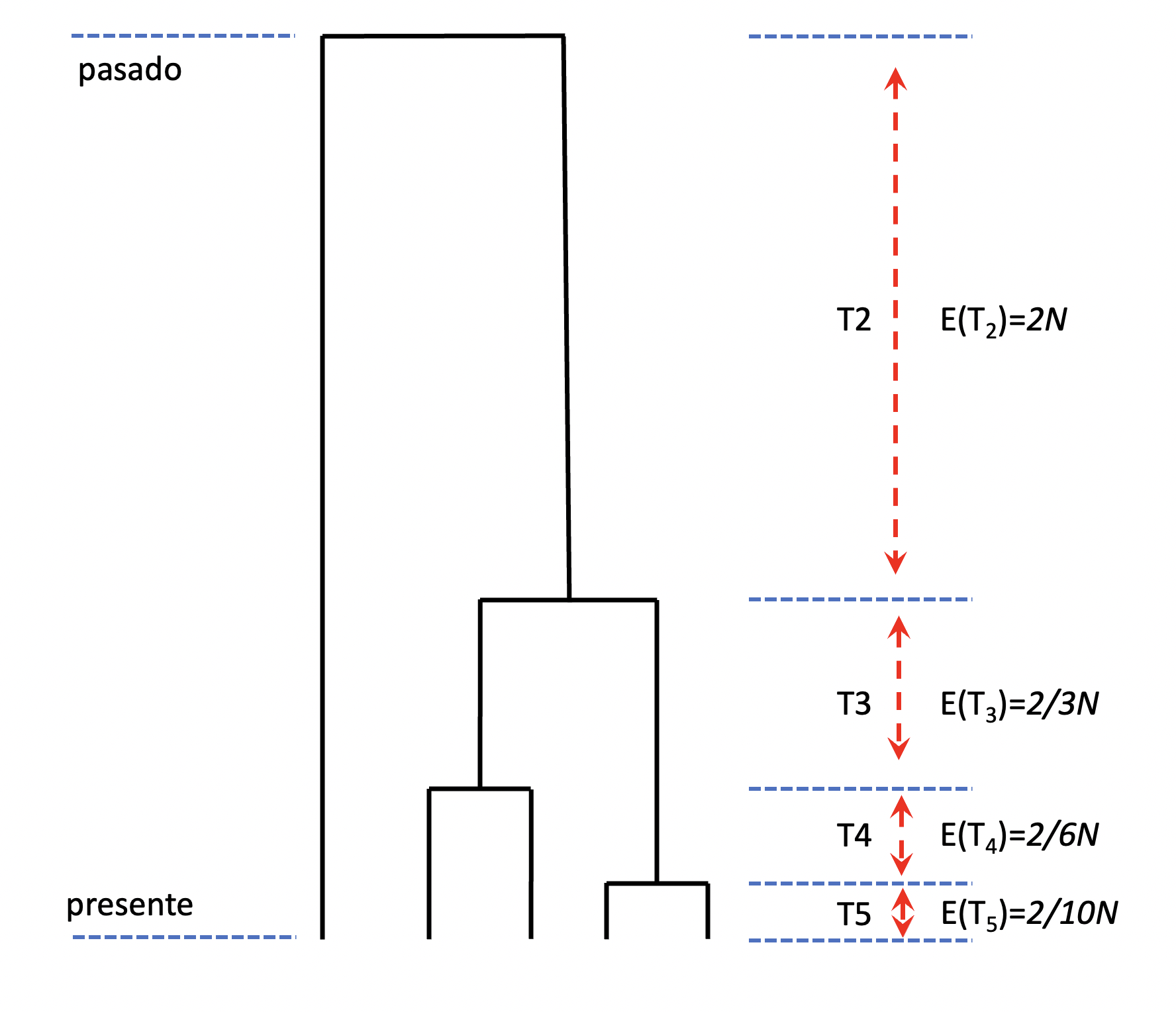

\(\square\) Presentar el modelo de coalescente, un modelo clave en genética de poblaciones. Este nos permitirá nos permitirá indagar en la historia de una muestra de alelos, yendo hacia atrás en el tiempo (hasta identificar su último ancestro común en una población), estimando los tiempos esperados en el proceso.

3.1 El rol de los procesos estocásticos en la genética

Para estudiar el alcance del azar en nuestro contexto propongamos un experimento conceptual sencillo, que cada persona puede reproducir en su casa. Tomemos una jarra o vaso grande y coloquemos 20 bolitas de vidrio azules y 20 bolitas de vidrio rojas, idénticas excepto por el color. Si, como es de esperar, no tienes tantas bolitas de diferentes colores, alcanza con hacer bolitas de papel coloreado o cosas similares, aunque nosotros nos seguiremos refiriendo en nuestro ejemplo a las bolitas. Por lo tanto, el estado inicial de nuestro experimento (la jarra) es:

| Azul | Roja | |

|---|---|---|

| Cantidad | 20 | 20 |

| Proporción | \(\frac{20}{40}\) | \(\frac{20}{40}\) |

Si sacas una bolita sin mirar el color, ¿qué esperas que ocurra? ¿Será roja o será azul? La extracción de una bolita de nuestra jarra se trata de un fenómeno aleatorio (no podemos saber el resultado con certeza), aunque en algunos casos podemos hacer conjeturas razonables. Por ejemplo, en nuestra jarra hay 20 bolitas azules y 20 rojas (\(20+20=40\) bolitas en total), por lo que la proporción de azules es \(p_{azul}=\frac{20}{40}=\frac{1}{2}=0,5\) y lo mismo para las rojas \(p_{roja}=\frac{20}{40}=\frac{1}{2}=0,5\) 33. Por lo tanto, como elegimos al azar qué bolita agarramos y no existe nada (en principio) que lleve a tener preferencias por el color al elegirlas (recordar que las estamos agarrando sin verlas) la probabilidad de tomar unas u otras será esencialmente la proporción de las mismas. Como la proporción de azules es igual a la de rojas (\(\frac{1}{2}\) en cada caso), lo único que podría conjeturar razonablemente es que hay tanta probabilidad de que aparezca una roja como una azul. Además, si reponemos la bolita elegida en la jarra la situación vuelve a ser como al principio (20 rojas y 20 azules), por lo que podemos repetir la lógica tantas veces como queramos.

Supongamos ahora que la bolita que sacamos antes fue azul y que en lugar de reponerla la dejamos afuera del juego (la puedes colocar en una caja). Tenemos ahora como estado del sistema antes de extraer la siguiente bolita:

| . | Azul | Roja |

|---|---|---|

| Cantidad | 19 | 20 |

| Proporción | \(\frac{19}{39}\) | \(\frac{20}{39}\) |

¿Cuál será la probabilidad, en una nueva extracción de la jarra, de sacar una bolita azul? ¿Será nuevamente equiprobable sacar una bolita roja que una azul? Para responder a estas preguntas debemos volver a hacer las cuentas. La probabilidad de sacar una bolita azul en la segunda extracción, dado que la primera fue azul y que no la repusimos es de \(p_{azul}=\frac{19}{39} \sim 0,4872\), y la probabilidad de sacar una roja será por lo tanto \(p_{roja}=\frac{20}{39} \sim 0,5128\) (notar que ahora en lugar de 40 bolitas solo teníamos 39 antes de sacar la segunda). La diferencia de probabilidades respecto al experimento original es relativamente pequeña, pero aún así real: \(p_{azul}=0,5\) en la primer extracción, mientras que \(p_{azul} \sim 0,4872\) en la segunda.

Supongamos que, una vez más, en la segunda extracción volvió a aparecer una bolita azul, algo nada extraño ya que existían aún en la jarra casi tantas bolitas rojas como azules. Nuevamente, la dejamos afuera de la jarra (la guardamos en la caja, junto a la primera). El estado actual de nuestro sistema es, por lo tanto:

| Azul | Roja | |

|---|---|---|

| Cantidad | 18 | 20 |

| Proporción | \(\frac{18}{38}\) | \(\frac{20}{38}\) |

Ahora, si volvemos a hacer las cuentas previas a una tercer extracción, tenemos que \(p_{azul}=\frac{18}{38} \sim 0,47372\), y la probabilidad de sacar una roja será por lo tanto \(p_{roja}=\frac{20}{38} \sim 0,5263\) (siempre la suma de \(p_{azul}+p_{roja}=1\)). Claramente, si empezamos (por azar) a extraer más bolitas azules que rojas (o más rojas que azules) y no reponemos, la probabilidad de volver a sacar una del mismo color que las que venían saliendo tiende a bajar.

Vayamos para atrás en el tiempo (afortundamente podemos hacerlo porque se trata de un experimento conceptual). Supongamos en cambio que luego de haber sacado la primera bolita azul, la segunda hubiese sido roja y, por supuesto, no repusimos ninguna de las dos. En este escenario la probabilidad de sacar una bolita azul en la tercera extracción hubiese sido \(p_{azul}=\frac{19}{38}=\frac{1}{2}=0,5\), y la de sacar una roja hubiese sido también \(p_{roja}=\frac{19}{38}=\frac{1}{2}=0,5\). En otras palabras, como volvimos a igualar las proporciones respecto al estado inicial de la jarra (cuando había 40 bolitas), la probabilidad de extraer alguno de los dos colores hubiese sido la misma.

Hasta ahora habíamos parado nuestro experimento luego de la extracción de dos bolitas. Veamos un experimento real, pero sigámoslo hasta que no queden más bolitas en la jarra. Las extracciones han seguido el orden que aparece en la primer columna (“bolita”) de la Tabla 3.1. Es fundamental entender que este es el resultado de un experimento en particular. Si repetimos el experimento el resultado (orden de salida de las bolitas) posiblemente sea muy distinto. Tenemos solo 39 filas y no 40, porque la última extracción ya no es aleatoria y porque además no tiene sentido calcular las proporciones luego de esa última extracción (ya no quedan más bolitas).

| bolita | rojas | azules | p.roja | p.azul |

|---|---|---|---|---|

| azul | 20 | 19 | 0,5128 | 0,4872 |

| roja | 19 | 19 | 0,5000 | 0,5000 |

| roja | 18 | 19 | 0,4865 | 0,5135 |

| azul | 18 | 18 | 0,5000 | 0,5000 |

| azul | 18 | 17 | 0,5143 | 0,4857 |

| azul | 18 | 16 | 0,5294 | 0,4706 |

| roja | 17 | 16 | 0,5152 | 0,4848 |

| roja | 16 | 16 | 0,5000 | 0,5000 |

| azul | 16 | 15 | 0,5161 | 0,4839 |

| roja | 15 | 15 | 0,5000 | 0,5000 |

| roja | 14 | 15 | 0,4828 | 0,5172 |

| azul | 14 | 14 | 0,5000 | 0,5000 |

| roja | 13 | 14 | 0,4815 | 0,5185 |

| azul | 13 | 13 | 0,5000 | 0,5000 |

| roja | 12 | 13 | 0,4800 | 0,5200 |

| roja | 11 | 13 | 0,4583 | 0,5417 |

| azul | 11 | 12 | 0,4783 | 0,5217 |

| azul | 11 | 11 | 0,5000 | 0,5000 |

| roja | 10 | 11 | 0,4762 | 0,5238 |

| roja | 9 | 11 | 0,4500 | 0,5500 |

| roja | 8 | 11 | 0,4211 | 0,5789 |

| roja | 7 | 11 | 0,3889 | 0,6111 |

| azul | 7 | 10 | 0,4118 | 0,5882 |

| roja | 6 | 10 | 0,3750 | 0,6250 |

| roja | 5 | 10 | 0,3333 | 0,6667 |

| azul | 5 | 9 | 0,3571 | 0,6429 |

| azul | 5 | 8 | 0,3846 | 0,6154 |

| azul | 5 | 7 | 0,4167 | 0,5833 |

| azul | 5 | 6 | 0,4545 | 0,5455 |

| azul | 5 | 5 | 0,5000 | 0,5000 |

| roja | 4 | 5 | 0,4444 | 0,5556 |

| roja | 3 | 5 | 0,3750 | 0,6250 |

| azul | 3 | 4 | 0,4286 | 0,5714 |

| roja | 2 | 4 | 0,3333 | 0,6667 |

| azul | 2 | 3 | 0,4000 | 0,6000 |

| azul | 2 | 2 | 0,5000 | 0,5000 |

| azul | 2 | 1 | 0,6667 | 0,3333 |

| azul | 2 | 0 | 1,0000 | 0,0000 |

| roja | 1 | 0 | 1,0000 | 0,0000 |

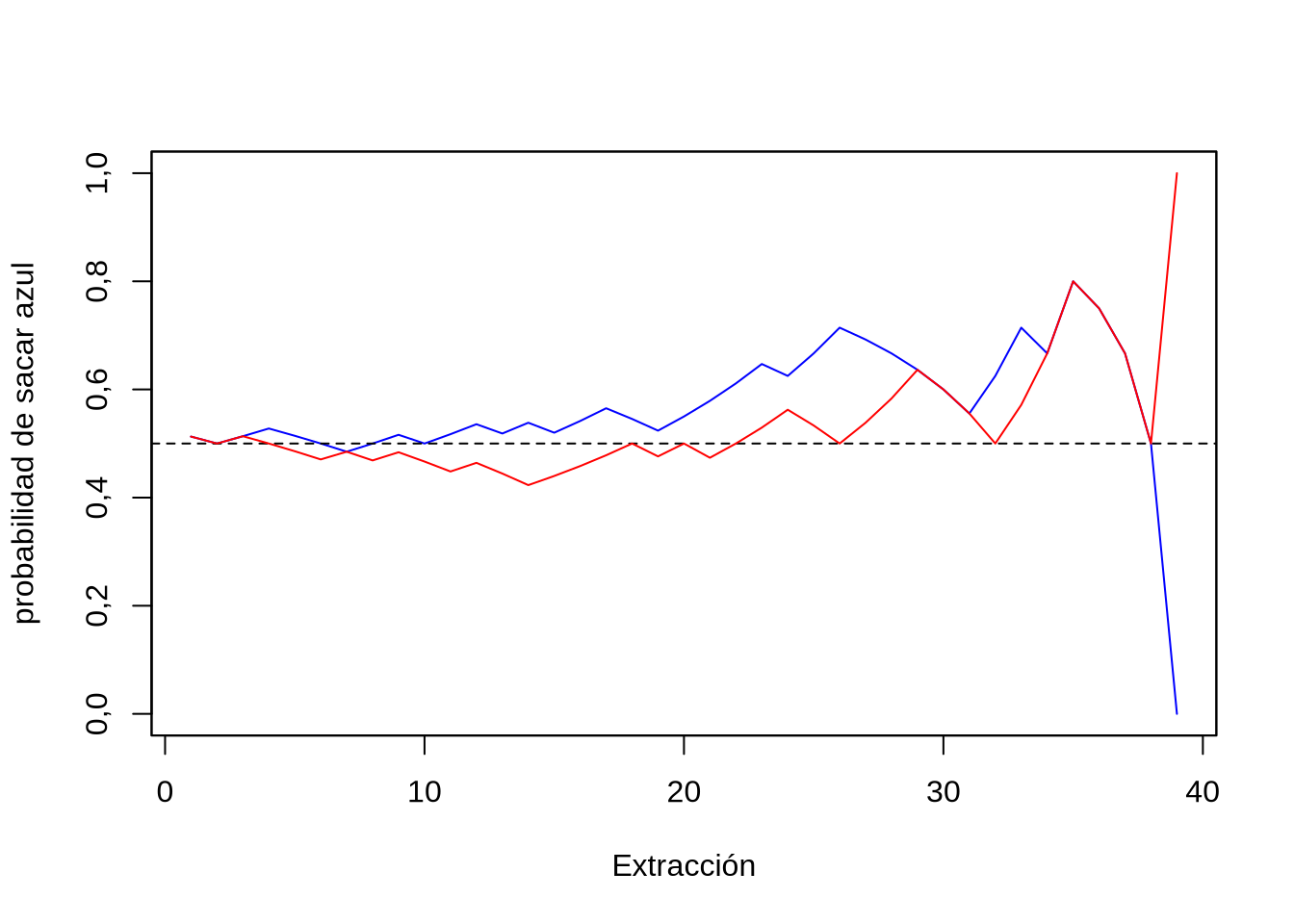

El resultado de graficar las proporciones de bolitas azules remanentes (probabilidades de extraer una bolita azul) la podemos ver en la Figura 3.1. Claramente, arrancando desde una proporción de \(p_{azul}=\frac{1}{2}\), como tenemos muchas bolitas, al comienzo las variaciones en las proporciones son relativamente pequeñas en cada extracción. A medida que van quedando cada vez menos bolitas (porque se trata de un muestreo sin reposición), las oscilaciones son cada vez mayores hasta que llegamos a una de las dos barreras absorbentes que tiene nuestro experimento: las proporciones de 0 (0%) y de 1 (100%). Se les denomina barreras absorbentes porque luego de llegar a estos valores no podremos escaparnos hacia otros (insistiremos en este concepto en breve). Es decir, luego de que llegamos a la proporción de 0 bolitas azules (y por lo tanto una proporción de 0), no hay forma de incrementar esa proporción. Lo mismo para la proporción de 1, cuando todas las bolitas que quedan son azules: la proporción se mantendrá así hasta el final del experimento.

Figura 3.1: Probabilidad de sacar una bolita azul en la próxima extracción, para un nuevo experimento (en rojo), con las mismas condiciones iniciales.

Claramente, el inicio del experimento es igual al del anterior (en los dos partimos de \(p_{azul}=\frac{1}{2}\)), y el mismo debe terminar en una proporción de bolitas azules de 0 o de 1, cuando no queden más bolitas azules o cuando todas las que queden sean azules (esa es la razón también por la que no ploteamos hasta después de la última extracción).

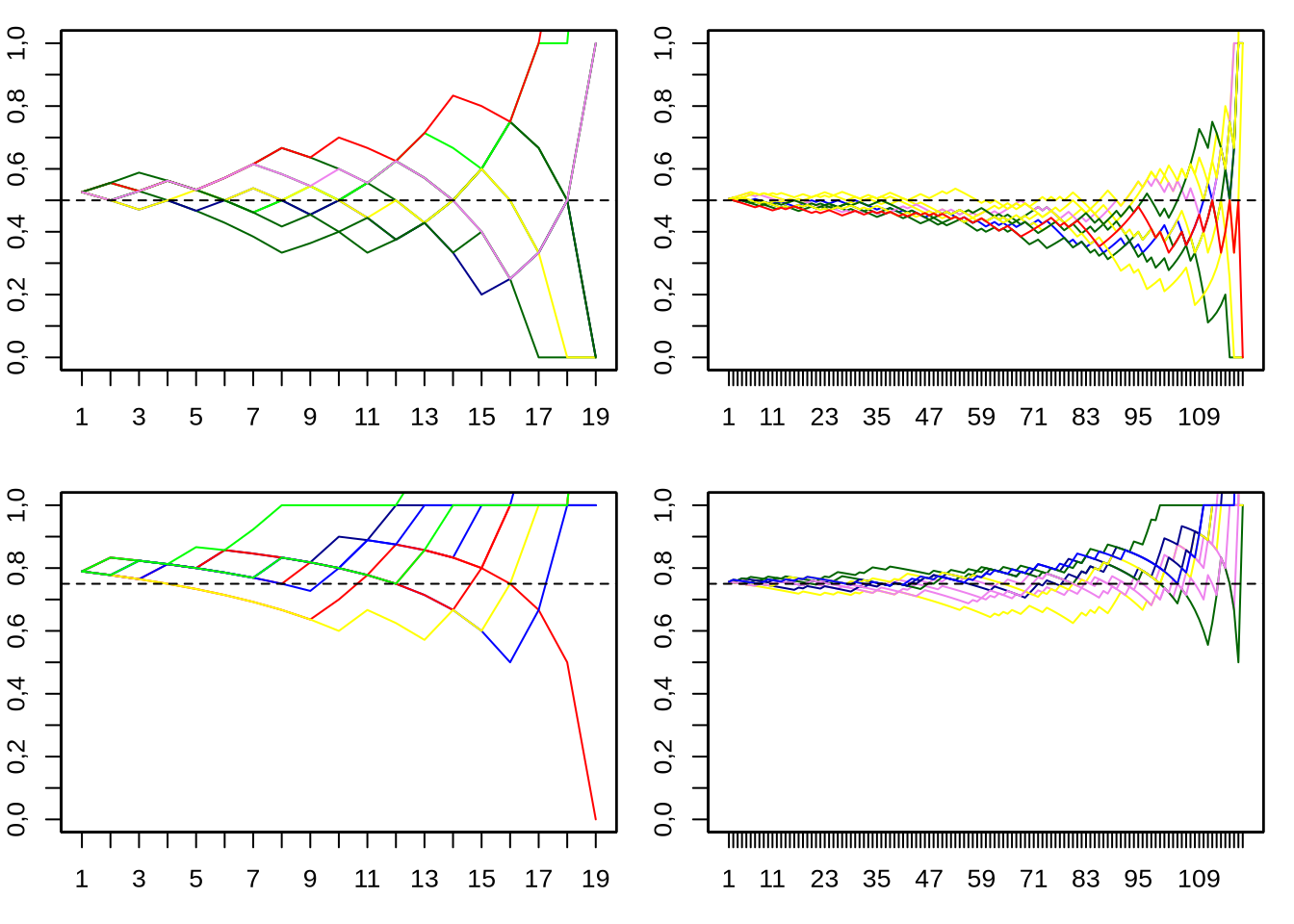

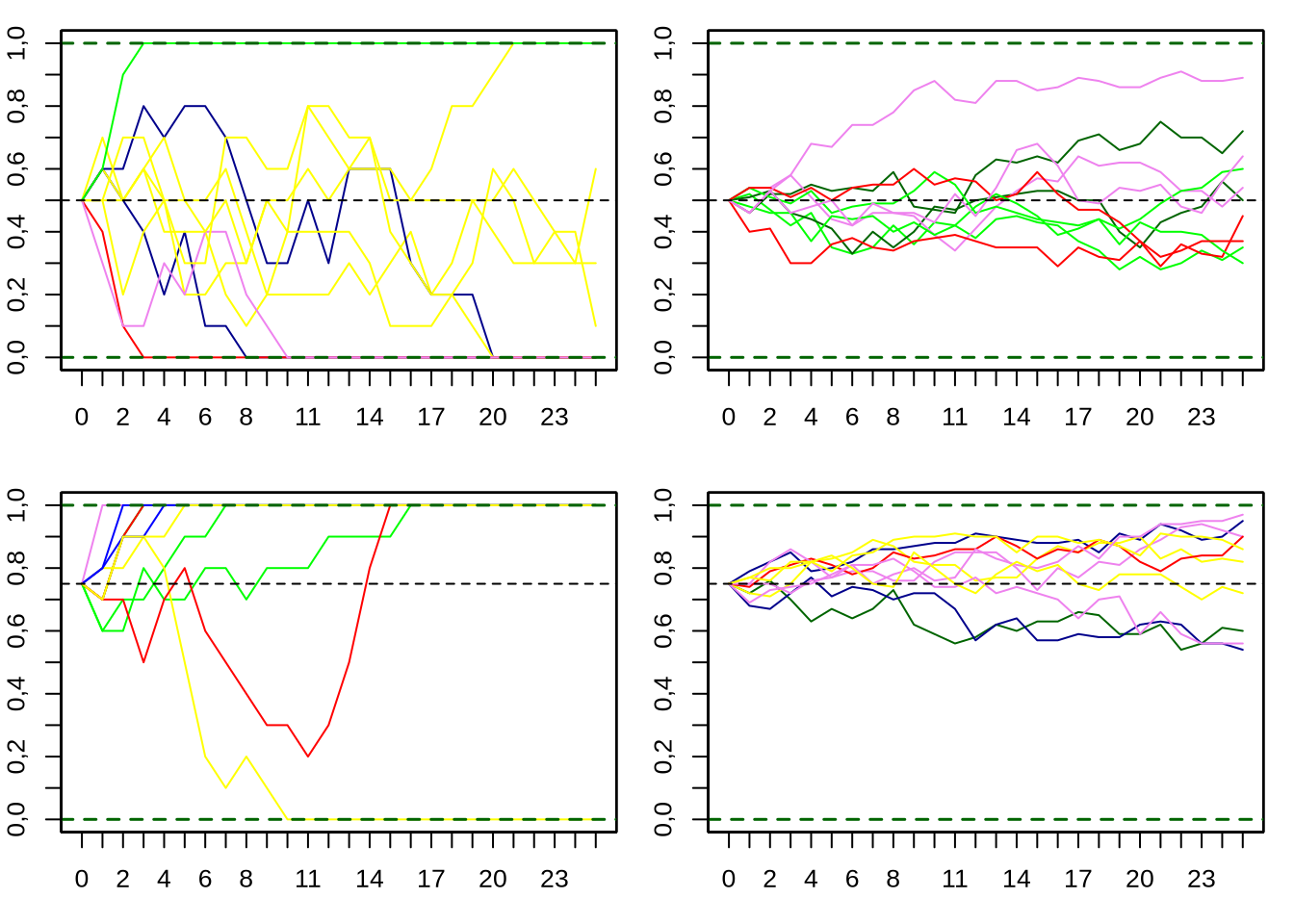

¿Qué ocurriría con nuestro experimento si hubiésemos tomado otro punto de partida (i.e., distinto número de bolitas azules que rojas), o si hubiésemos arrancado desde un número mayor o menor de bolitas?. Afortunadamente, es muy fácil realizar estos experimentos en una computadora y analizar los resultados, al menos para tener una primera impresión del comportamiento cualitativo del sistema. En la Figura 3.2 se observa qué ocurre al variar el número de bolitas en nuestra jarra (columna de la izquierda: 20 bolitas, columna de la derecha: 120 bolitas) y variando la frecuencia (proporción) de bolitas azules al comienzo (fila superior: \(p_{azul}=\frac{1}{2}\), fila inferior: \(p_{azul}=\frac{3}{4}\)).

Figura 3.2: Probabilidad de sacar una bolita azul en la próxima extracción, para 10 experimentos, para 4 condiciones: p=1/2 (arriba) y p=3/4 abajo, en 20 (izquierda) y 120 (derecha) bolitas.

A partir de la Figura 3.2 podemos empezar a sacar algunas conclusiones de este experimento aleatorio que nos servirán de referencia en breve. La primera conclusión se relaciona con algo que ya habíamos visto: a medida que quedan menos bolitas en la jarra, ya sea porque se comenzó con pocas o porque el experimento se acerca a su fin, las variaciones en frecuencias suelen ser más drásticas. Esto se puede observar, por ejemplo, en la figura de arriba a la derecha: al principio las variaciones entre distintas réplicas del experimento apenas se apartan de la línea a trazos, pero a medida que quedan menos bolitas (aumenta el número de experimentos que ya realizamos) las proporciones en cada experimento empiezan a ser cada vez más variables (existe mayor dispersión en torno a la línea a trazos). La segunda conclusión refiere al punto de partida del experimento: a medida de que nos alejamos del punto medio (igual proporción de bolitas azules que rojas), mayor es la probabilidad de que la última bolita que quede en la jarra sea una bolita del tipo con mayor proporción inicial. De hecho, la probabilidad de que la última bolita sea de uno de los dos colores, si realizamos repetidas veces el mismo experimento, es la probabilidad inicial del tipo al que pertenece dicha bolita. Podemos ver esto claramente a partir de un ejemplo. Supongamos que tenemos al inicio 10 bolitas en la jarra, 9 de ellas azules y una roja. Para que la roja sea la última en salir, todas las anteriores extracciones deben dar como resultado bolitas azules. La probabilidad de que la bolita roja sobreviva a la primer extracción (o sea, que la primer bolita sea azul) es \(\frac{9}{10}\) (ya que hay 9 bolitas azules y solo una roja). La de la segunda, asumiendo que la primera fue azul y que por lo tanto la bolita roja sobrevivió a la primer tirada, es de \(\frac{8}{9}\). La de la tercera será entonces \(\frac{7}{8}\), y así sucesivamente hasta que queden dos bolitas: una roja y otra azul. En este caso, la probabilidad de elegir nuevamente una bolita azul es de \(\frac{1}{2}\). Considerando estos eventos en conjunto (multiplicando sus respectivas probabilidades), tenemos:

\[\begin{equation} P(\text{última}=\text{roja})=\frac{9}{10} \cdot \frac{8}{9} \cdot \frac{7}{8} \cdot ... \cdot \frac{1}{2}=\frac{\prod_{1}^9}{\prod_{2}^{10}}=\frac{9!}{10!}=\frac{1}{10} \end{equation}\]

que es la proporción de bolitas rojas al inicio 34.

De hecho, podemos generalizar fácilmente el razonamiento anterior a otra proporción de bolitas rojas y azules. Supongamos ahora que tenemos como punto de partida 4 bolitas rojas y 6 azules. ¿Cuál es la probabilidad de que la última bolita sea de color rojo? Llamemos \(n\) al número total de bolitas (\(n=10\), en nuestro experimento) y \(k\) al número de bolitas rojas (\(k=4\), ídem). El total de posibles órdenes en que salen todas las bolitas es igual a las permutaciones de \(n\) elementos, dado por \(\mathbb{P}(n)=n!\). Para que la ultima bolita sea roja, separamos una de ellas del conjunto, por lo que ahora solo tenemos \(n-1=9\) bolitas. Notemos que el orden de salia de las mismas es irrelevante, por lo que hay \(\mathbb{P}{(n-1)}=(n-1)!\) posibilidades (órdenes de salida) de que esto suceda. Por lo tanto, dado que agarramos una bolita roja en particular, la probabilidad de que esa salga última será \(\frac{\mathbb{P}{(n-1)}}{\mathbb{P}{(n)}}=\frac{(n-1)!}{n!}=\frac{\prod_{1}^{n-1}}{\prod_{1}^{n}}=\frac{1}{n}\). Sin embargo, hay \(k\) bolitas rojas diferentes y para cualquiera de ellas este razonamiento es válido, por lo que debemos multiplicar la probabilidad anterior por \(k\) (todos son eventos disjuntos). Considerando esto, tenemos que la probabilidad de que la última bolita sea roja es

\[\begin{equation} \mathbb{P}(\text{última}=\text{roja})=k \frac{\mathbb{P}{(n-1)}}{\mathbb{P}{(n)}}=k \frac{(n-1)!}{n!}=k \frac{\prod_{1}^{n-1}}{\prod_{1}^{n}}=\frac{k}{n} \end{equation}\]

que es la probabilidad inicial de sacar una bolita roja (\(k/n\), \(4/10\) en nuestro caso) o, lo que es lo mismo, la proporción inicial de bolitas rojas. La utilidad de todo este razonamiento lo veremos en la siguiente sección (El modelo de Wright-Fisher ).

PARA RECORDAR

- La importancia de las proporciones de partida puesto que estas determinaran las probabilidades de obtener cierto resultado.

- Las barreras absorbentes serán aquellos valores que no podremos sobrepasar, y representarán los “límites” de los que no podremos escapar hacia otros valores.

3.2 El modelo de Wright-Fisher

A esta altura, ya habrás comenzado a imaginarte la relación entre los experimentos aleatorios de la sección anterior y nuestro modelo de poblaciones con un número relativamente pequeño de individuos. Si bien es posible imaginarse y modelar todo el proceso de gametogénesis, apareamientos al azar para constituir los genotipos de la próxima generación y repetir esto tantas veces como queramos, Sewall Wright 35 y Ronald Fisher 36 imaginaron un procedimiento mucho más sencillo que permite arribar a las misma conclusiones con mucho menos esfuerzo de cálculo.

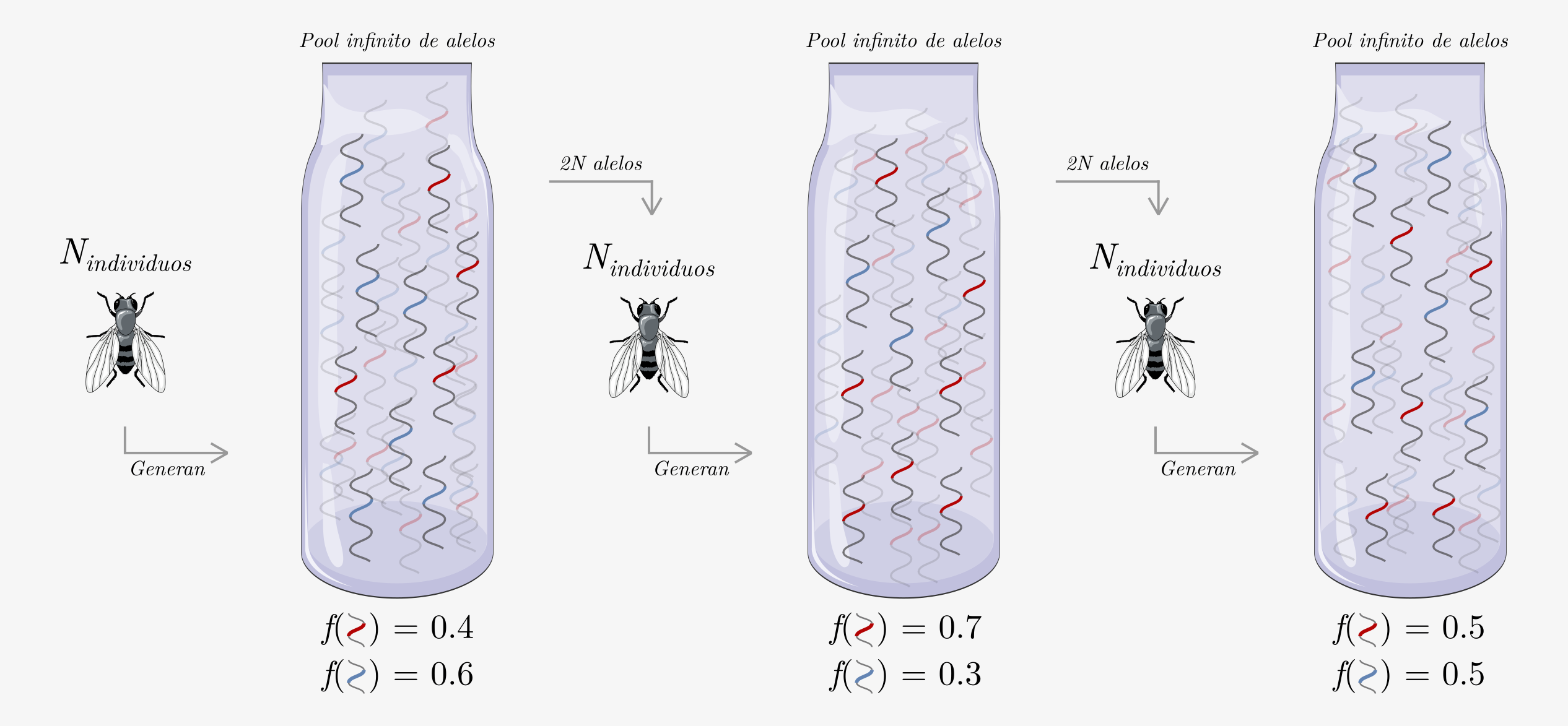

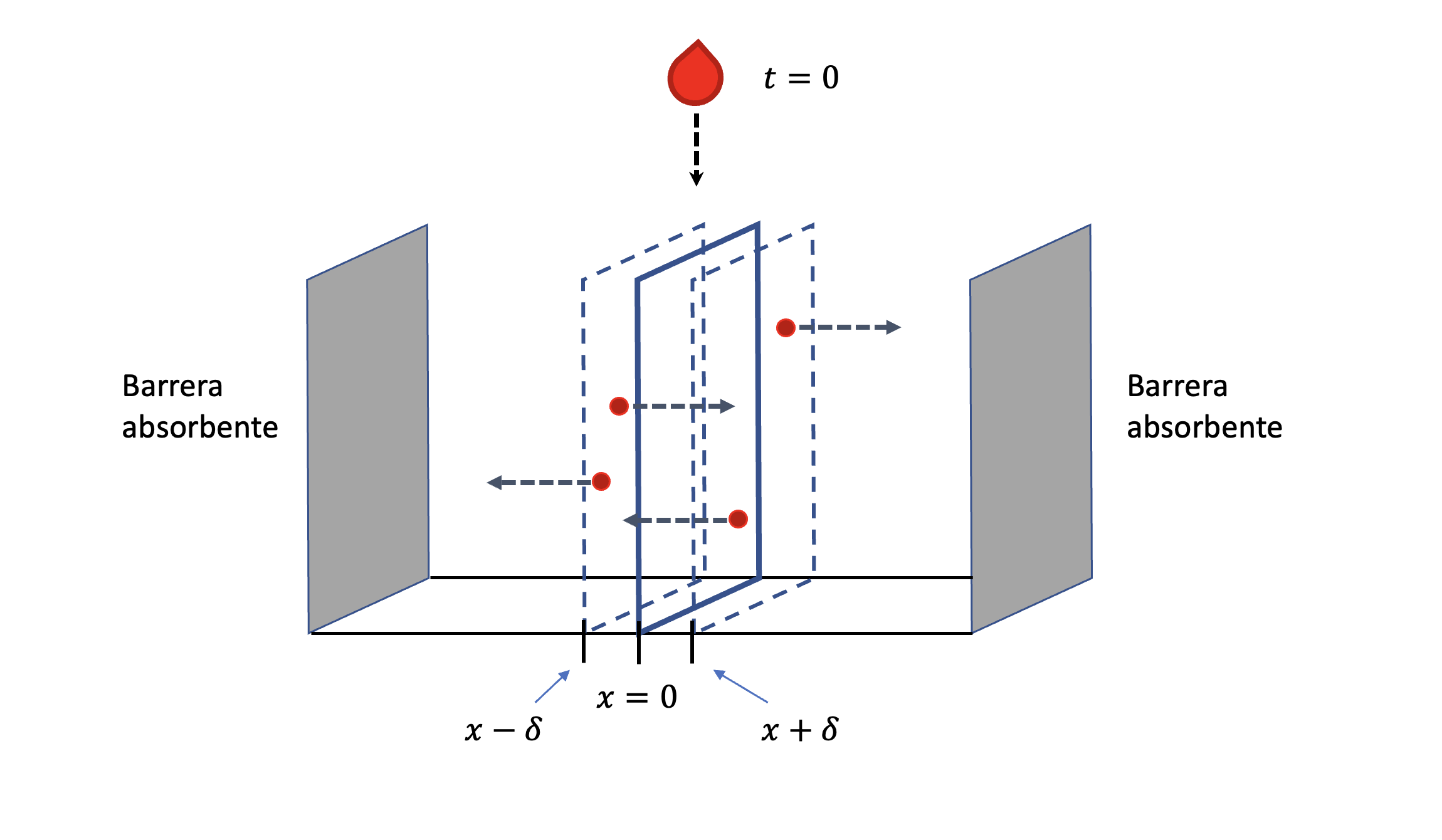

La primera suposición que hace el modelo de Wright-Fisher es que, más allá del número de individuos, el pool de gametos (el conjunto de todos los gametos en la población) es infinito. Si bien esto puede parecer extraño, es importante recordar que el número de espermatozoides (gametos masculinos) que producen los machos es virtualmente enorme, y el número de óvulos que produce cada hembra es de órdenes de magnitud superior que su descendencia; teniendo esto en cuenta, este no parece un supuesto arriesgado. Los otros supuestos incluyen: i) ausencia de selección, ii) ausencia de mutaciones, iii) ausencia de migración, iv) tiempos de generación no superpuestos, y v) apareamiento aleatorio (panmixia). Si bien no suena realista que se cumplan todas estas condiciones en la vida real, el apartamiento de las mismas suele ser lo suficientemente menor como para considerar el modelo como una buena aproximación inicial. El proceso que plantean Wright-Fisher para el modelo de un gen con dos alelos es el siguiente: para una población de \(N\) individuos de una especie diploide, dada la frecuencia de uno de los alelos muestrear al azar del pool infinito \(2N\) alelos. Está será nuestra nueva población. La lógica del modelo Wright-Fisher se ve graficada para un caso con \(N\) individuos en la Figura 3.3, donde además se hace explícita la analogía con el experimento mental de bolitas que desarrollamos anteriormente.

Figura 3.3: Representación esquemática del modelo de Wright-Fisher. Una población finita de N individuos (de la especie , en este ejemplo) generan en cada generación un pool infinito de alelos que mantiene las frecuencias alélicas de la generación. La próxima generación se compone muestreando 2N alelos con reposición, los cuales conformarán a los N individuos de la generación. Imagen creada con elementos gráficos tomados de bioicons (https://bioicons.com/).

Podemos repetir el procedimiento. tantas veces como queramos para estudiar el comportamiento a lo largo del tiempo de nuestro modelo. hora, suponemos que ya te habrás preguntado cómo hacemos para muestrear de un pool infinito a partir de un número limitado de alelos disponibles (\(2N\)). El truco es muy sencillo, la diferencia entre un muestreo con reposición y un muestreo sin reposición (el que hicimos en la sección precedente) es que mientras que en este último las frecuencias van variando a medida de que vamos extrayendo muestras, en el primero (con reposición) las frecuencias permanecen incambiadas definitivamente. Claramente, cuando el muestreo es de a una bolita (o alelo) esto se asemeja a muestrear de un pool infinito de bolitas (o alelos).

Veamos cómo funciona en la práctica. Supongamos que tenemos una población de \(N=5\) individuos. Supongamos además de que se trata de un locus con dos alelos, \(A\) representado por bolitas azules y \(a\) representado por las bolitas rojas. Para simplificar y que se fije la idea del procedimiento vamos a comenzar con una frecuencia inicial de \(p_A=p_{azul}=\frac{1}{2}=p_{roja}=p_a\). Para que nuestro procedimento funcione claramente vamos a tener ahora dos jarras (una inicialmente con igual proporción de bolitas azules y rojas y la otra vacía) y una caja con al menos \(2N\) bolitas de cada color, o sea que en nuestro ejemplo, al menos 10 bolitas azules y 10 bolitas rojas.

La jarra vacía va a representar una nueva generación de nuestra población. Para completarla procederemos extrayendo al azar de la jarra llena una bolita y de acuerdo al color de la misma sacamos de la caja una bolita del mismo color y la colocamos en la jarra vacía, devolviendo la bolita que sacamos a la jarra llena. Repetimos este procedimiento \(2N\) veces, al cabo del cual tendremos \(2N\) bolitas en nuestra antigua jarra vacía (la nueva generación de la población). Para completar el procedimiento y estar prontos para una nueva generación, vaciamos el contenido de la anterior jarra llena en la caja.

En este punto, podemos analizar el contenido de la nueva jarra llena (la población “hija” de la inicial), contando cuántas bolitas de cada color obtuvimos. Ahora, ¿podemos predecir (de alguna manera) el comportamiento de este experimento en una generación? Si llamamos (arbitrariamente) un “éxito” al hecho de sacar una bolita de color azul, entonces la extracción de cada bolita será una variable aleatoria con distribución de Bernoulli37 y probabilidad de éxito \(p_{azul}\) (y por lo tanto, probabilidad de fracaso, bolita roja, \(p_{roja}=1-p\)). Si consideramos el resultado de las \(2N\) extracciones independientes y con la misma probabilidad (recordar que es un muestreo con reposición) como un conjunto, entonces la distribución del número de bolitas azules (éxitos) y rojas (fracasos) entre las \(2N\) tenga una distribución binomial:

\[ \begin{split} P(i \text{ bolitas azules})={2N\choose i} p^i (1-p)^{2N-i},\\ {2N\choose i}=\frac{2N!}{i!(2N-i)!} \end{split} \tag{3.1} \]

Es decir, si bien el número de bolitas en la nueva jarra también es de \(2N=10\), ahora el número de bolitas azules (copias del alelo A) que llamamos \(i\) (y por lo tanto el de bolitas rojas, o alelo a igual a \(2N-i\)) es una variable aleatoria y por lo tanto con resultado incierto de experimento en experimento. En general, si una población tiene \(i\) copias del alelo \(A\) y \(2N-i\) copias del alelo \(a\), la probabilidad de transición de pasar de \(i\) copias a \(j\) copias en el modelo de Wright-Fisher se encuentra dada por la siguiente ecuación:

\[\begin{equation} T_{ij}={2N \choose j}\left(\frac{i}{2N}\right)^{j}\left(\frac{2N-i}{2N}\right)^{2N-j}=\frac{(2N)!}{j!(2N-j)!}p^jq^{2N-j} \tag{3.2} \end{equation}\]

Esta ecuación es bien sencilla de explicar. La probabilidad de éxito (alelo A o bolita azul) varía de generación en generación, y por lo tanto para la generación actual de gametos es igual a la proporción de alelos A (\(i\)) en el total (\(2N\)), por lo que para cada generación de gametos \(p=\frac{i}{2N}\). Concomitantemente, la probabilidad de fracaso (alelo a o bolita roja) es igual a la proporción de alelos a en el total, o sea \(\frac{2N-i}{2N}\). Ahora, al número de éxitos en la siguiente generación le llamamos \(j\) (la cantidad de alelos A que tienen la probabilidad \(T_{ij}\)) y por lo tanto, la cantidad de alelos a será \(2N-j\).

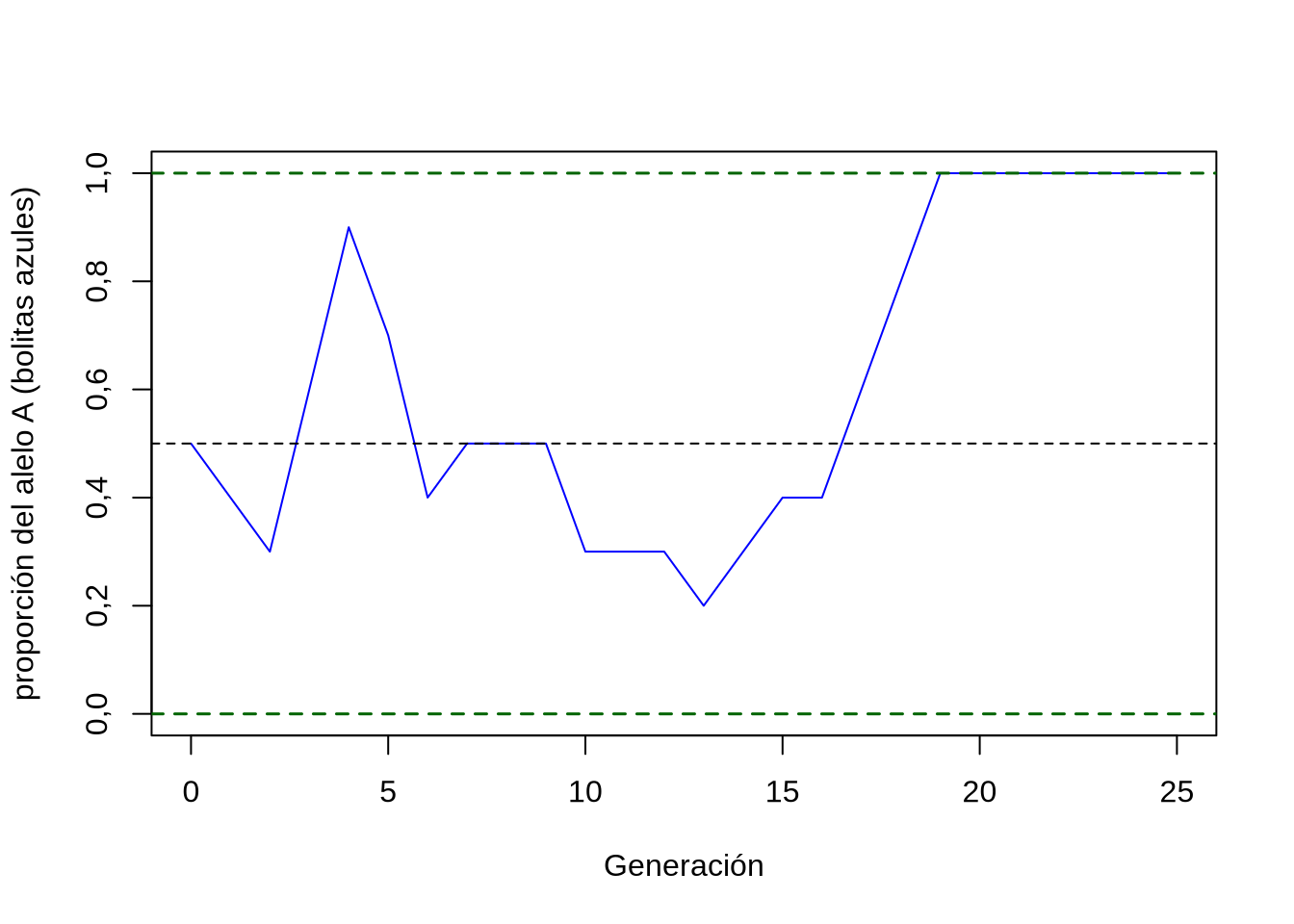

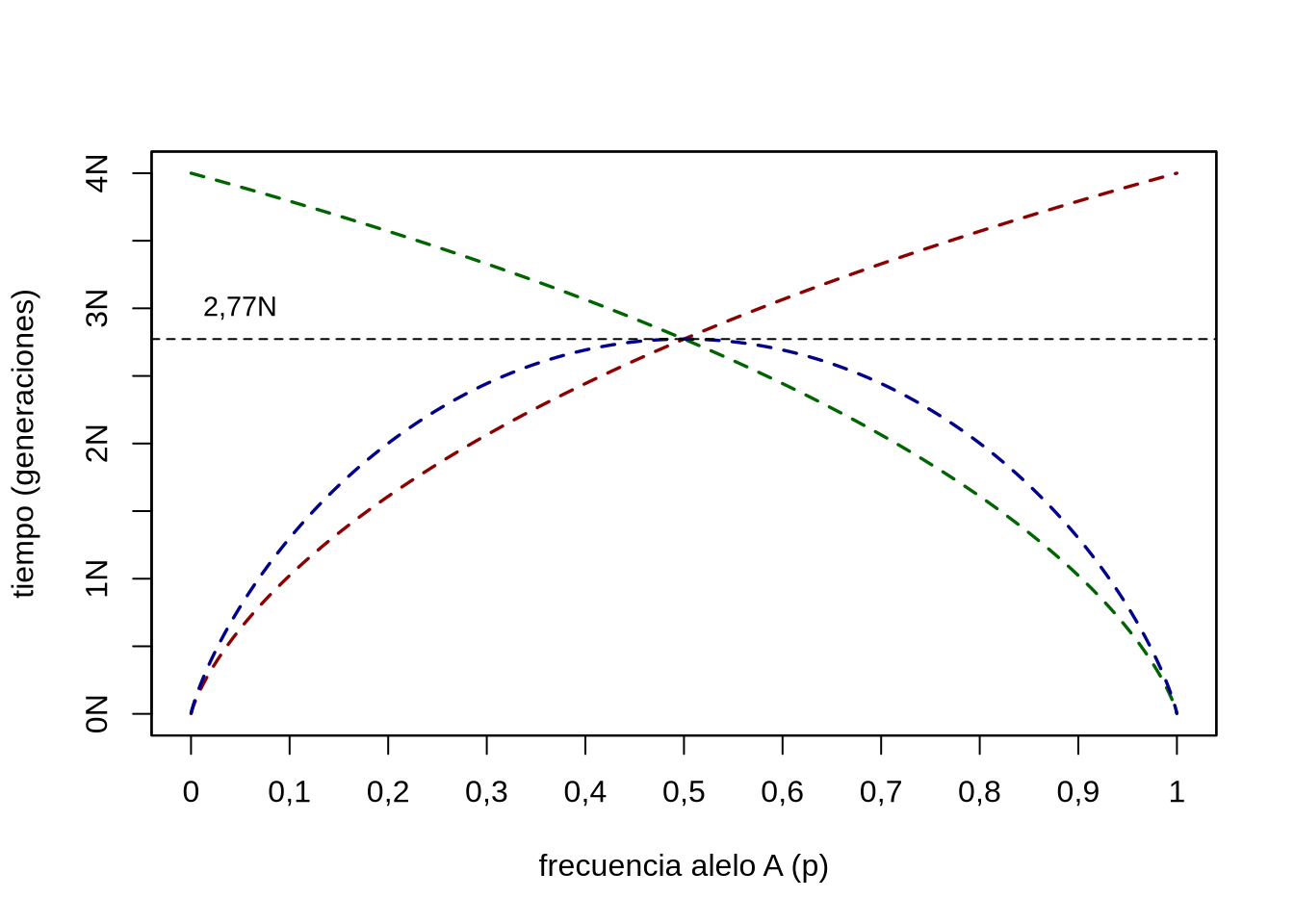

Hasta ahora nos hemos referido a una población en particular y como vimos su evolución es completamente al azar. En la Figura 3.4 podemos ver un ejemplo de la evolución del alelo A en una población de 5 individuos diploides. El punto de partida es de \(p_{A}=\frac{1}{2}\) y el aspecto de “dientes de sierra” se debe a que lo más fino que puede ser el movimiento es de \(\frac{1}{2N}=\frac{1}{10}=0,1\) en nuestro caso. Por otro lado, tanto \(p_A=0\) como \(p_A=1\) son barreras absorbentes ya que \(p_A=0\) quiere decir que no quedan más alelos A (bolitas azules) en la población, mientras que \(p_A=1\) quiere decir que todos los alelos que quedan en la población son A, es decir que este alelo se fijó en la población (y por lo tanto, en ambos casos la frecuencia no variará más en el tiempo; recordar que uno de los supuestos fue que no hay mutación).

Afortunadamente a partir de unas pocas líneas de código podemos explorar a nuestro antojo el comportamiento en varias poblaciones, conjunto que se llama ensemble (del francés, el conjunto de todos los individuos de todas las poblaciones; ver Figura 3.6), variando el número de individuos en ellas, así como la proporción inicial del alelo A. El resultado de probar el comportamiento para poblaciones de 5 y 50 individuos, con proporción inicial de alelo de \(p=\frac{1}{2}\) y \(p=\frac{3}{4}\) lo podemos ver en la Figura 3.5. Claramente podemos apreciar que las poblaciones con mayor número de individuos tienen un comportamiento menos errático. Por otro lado, en las poblaciones que arrancan más cerca de una de las barreras absorbentes la variación es menor en relación a las poblaciones con el mismo número de individuos que arrancan desde la mitad (\(p=\frac{1}{2}\)).

Figura 3.4: Proporción del alelo A (bolitas azules) en una población de 5 individuos diploides. Notar de que se trata de una realización en particular de este experimento y que con seguridad si repetimos el experimento el resultado será diferente.

Figura 3.5: Frecuencia del alelo A (bolitas azules) en 10 poblaciones de 5 individuos diploides (a la izquierda) y de 50 individuos diploides (derecha), para frecuencias iniciales de p=1/2 (arriba) y p=3/4 (abajo).

Este comportamiento no debería resultarnos extraño. Los muestreos que estamos realizando en cada población, a cada generación, provienen de distribuciones binomiales. Si recuerdas de tus cursos de matemáticas y estadística, para una variable \(i \sim Binom(2N,p)\) se tiene valor esperado \(E(i)=2Np\) y varianza \(\sigma^2(i)=2Np(1-p)=2Np-2Np^2\), por lo que esperamos que mientras las poblaciones se encuentren segregando, la esperanza (la media) entre la distintas poblaciones sea de \(Np\), o lo que es lo mismo, la proporción del alelo A sea igual a \(p_A=\frac{E(i)}{2N}=\frac{2Np}{2N}=p\) (es decir, en promedio las líneas de poblaciones oscilarán en torno a la frecuencia inicial). Más aún, como vimos antes (H-W: la frecuencia de heterocigotas en función de la frecuencia alélica), \(p(1-p)\) tiene un máximo en \(p=\frac{1}{2}\), por lo que la varianza \(\sigma^2(i)=2Np(1-p)\) también tendrá un máximo en \(p=\frac{1}{2}\) (porque \(p(1-p)\) está multiplicado por \(2N\) que es necesariamente una constante positiva); en otras palabras, la varianza dentro de cada población será máxima cerca de la frecuencia \(p=\frac{1}{2}\). ¿Cómo se condice esto con el comportamiento más variable en poblaciones pequeñas? Si recuerdas de esos mismos cursos, la varianza en la frecuencia por generación en el ensemble viene dada por

\[\begin{equation} \sigma^2(i/(2N_e))= \frac{1}{(2N_e)^2} \cdot \sigma^2(i) \sigma^2(p)=\frac{2 N_e p(1-p)}{4 N_e^2}=\frac{p(1-p)}{2N_e} \Rightarrow \end{equation}\]

\[\begin{equation} \sigma^2(p)=\frac{pq}{2N_e}=\frac{p-p^2}{2N_e} \end{equation}\]

Es decir que al aumentar el tamaño de cada población (\(2N\)) la variación entre poblaciones disminuye. Finalmente, la variación entre poblaciones para las poblaciones que aún se encuentran segregando (o sea, que no llegaron a las barreras absorbentes) se incrementa con el tiempo de manera aproximadamente lineal, por lo que para tiempo \(t\) en las líneas que continúan segregando esperamos una varianza de

\[\begin{equation} \sigma_t^2(p)=t\frac{pq}{2N}=t\frac{(p-p^2)}{2N}. \end{equation}\]

Una última observación es la que hace al número de individuos \(N\) de las distintas poblaciones. Hasta ahora asumimos que cada uno de nuestros individuos era completamente independiente de los otros desde el punto de vista genético (es decir, asumimos condiciones ideales) y por lo tanto no tuvimos en cuenta el efecto de que se puedan ver emparentadas en nuestros cálculos. En realidad, en la práctica, bajo diferentes criterios (apareamientos dirigidos, diferencias en el número de progenie esperada por pareja, etc.), las poblaciones se suelen comportar como si el número de individuos fuese menor y a ese número se lo conoce como tamaño efectivo de la población y se lo representa con el símbolo \(N_e\). Esto lo veremos con más detalle en la sección Tamaño efectivo poblacional y de nuevo en el capítulo Apareamientos no-aleatorios.

En resumen, a partir del modelo sencillo de Wright-Fisher pudimos entender que en ausencia de otras fuerzas evolutivas como la selección, migración o mutación, las frecuencias alélicas pueden variar en forma aleatoria y que con el transcurso del tiempo cada alelo puede fijarse en alguna población mientras que desaparece en otras. Este fenómeno es lo que se conoce como deriva genética o deriva aleatoria, este último término en razón de que el cambio en las frecuencias no tiene una dirección y que por lo tanto no es predecible el sentido para una población en particular.

Ejemplo 3.1

Una población de 1000 individuos es dividida en cuatro subpoblaciones, cada una con un tamaño poblacional efectivo de 250 individuos. Las poblaciones se encuentran segregando un locus bi-alélico, siguiendo todos los supuestos esperados para encontrarse en equilibrio de Hardy-Weinberg (salvo el de tamaño poblacional infinito). Luego de un tiempo, se observan las siguientes frecuencias alélicas (\(p_i\)) para el alelo \(A_1\) en el ensemble de subpoblaciones: \(p_1 = 0,39;\ p_2 = 0,61 ;\ p_3 = 0,57;\ p_4 = 0,42\). Estime el número de generaciones transcurrido desde la formación del ensemble de subpoblaciones.

A partir de las frecuencias alélicas observadas en el ensemble se estima una frecuencia promedio \(\bar{p} = \frac{0.39+0.61+0.57+0.42}{4} = 0.4975\). A su vez, la varianza observada para la frecuencia alélica en el ensemble es de \(\sigma_t^2(p) = \frac{1}{n}\sum_{i=1}^{i=n}(p_i - \bar{p})^2 = \frac{(0.39-0.4975)^2 + (0.61-0.4975)^2 + (0.57-0.4975)^2 + (0.42-0.4975)^2}{4} \Rightarrow \sigma_t^2(p) = 0, 00886875\).

Dado que la varianza para la frecuencia alélica \(p\) aumenta linealmente con el tiempo generacional \(t\) según la ecuación \(\sigma^2_t(p) = t \cdot \frac{pq}{2N_e}\), podemos usar nuestro estimado de \(\bar{p}\) y el tamaño poblacional efectivo \(N_e = 250\) para calcular el número de generaciones transcurrido desde la generación del ensemble:

\[\sigma^2_t(p) = t \cdot \frac{pq}{2N_e} \Rightarrow t = \frac{\sigma^2_t(p) \cdot 2N_e}{\bar{p}\bar{q}}\]

\[ t = \frac{0,00886875 \cdot 2\cdot250}{0,4975 \cdot (1-0,4975)}\]

por lo que inferimos que se estima pasaron \(t \approx 18\) generaciones desde la formación del ensemble poblacional.

PARA RECORDAR

- El modelo de Wright-Fisher asume que de un pool infinito de gametos, con las frecuencias de los alelos proporcionales a lo muestreado para constituir la generación anterior, muestreamos nuevamente \(2N\) alelos, que constituirá a la nueva población.

- La suposición de un pool infinito de gametos es equivalente, desde el punto de vista matemático a un muestreo con reposición.

- Al generarse la nueva población a partir de \(2N\) muestreos independientes de Bernoulli, la distribución de la nueva población será una Binomial con probabilidad \(p\) y tamaño \(2N\).

- La varianza de las frecuencias del alelo A (\(p\)) entre poblaciones, por generación, debida al efecto de la deriva genética es:

\[\begin{equation*} \sigma^2(p)=\frac{pq}{2N_e}=\frac{p-p^2}{2N_e} \tag{3.3} \end{equation*}\]

siendo \(p\) y \(q\) (con \(q=1-p\)) las frecuencias de los alelos y \(N_e\) el tamaño efectivo de las poblaciones que forman el ensemble. Como la varianza crece linealmente con el tiempo (en generaciones), tenemos también que para el tiempo \(t\) para las líneas que continúan segregando:

\[\begin{equation*} \sigma_t^2(p)=t\frac{pq}{2N_e}=t\frac{(p-p^2)}{2N_e} \tag{3.4} \end{equation*}\]

3.3 La subdivisión poblacional y la evolución de las frecuencias alélicas

La sección anterior marcó un cambio importante en nuestras perspectivas. Desde analizar el comportamiento de una o dos poblaciones, a partir de la sección anterior empezamos a apreciar que el azar puede jugar un rol muy importante en la evolución de las frecuencias alélicas en poblaciones relativamente pequeñas y nos empezamos a interesar en la visión en conjunto de las mismas.

El debate acerca del rol de la deriva genética versus la selección en los procesos de especiación (la aparición de nuevas especies) ha sido acalorado (ver, por ejemplo B. Charlesworth, Lande, and Slatkin (1982)). Aunque el debate continúa, pese a reconocer un rol no despreciable a la deriva genética, los actores principales de esta comedia que es la vida parecen ser la mutación (como generador de variabilidad) y la selección, a través de sus diversas formas de acción (algo que veremos en el capítulo de Selección Natural).

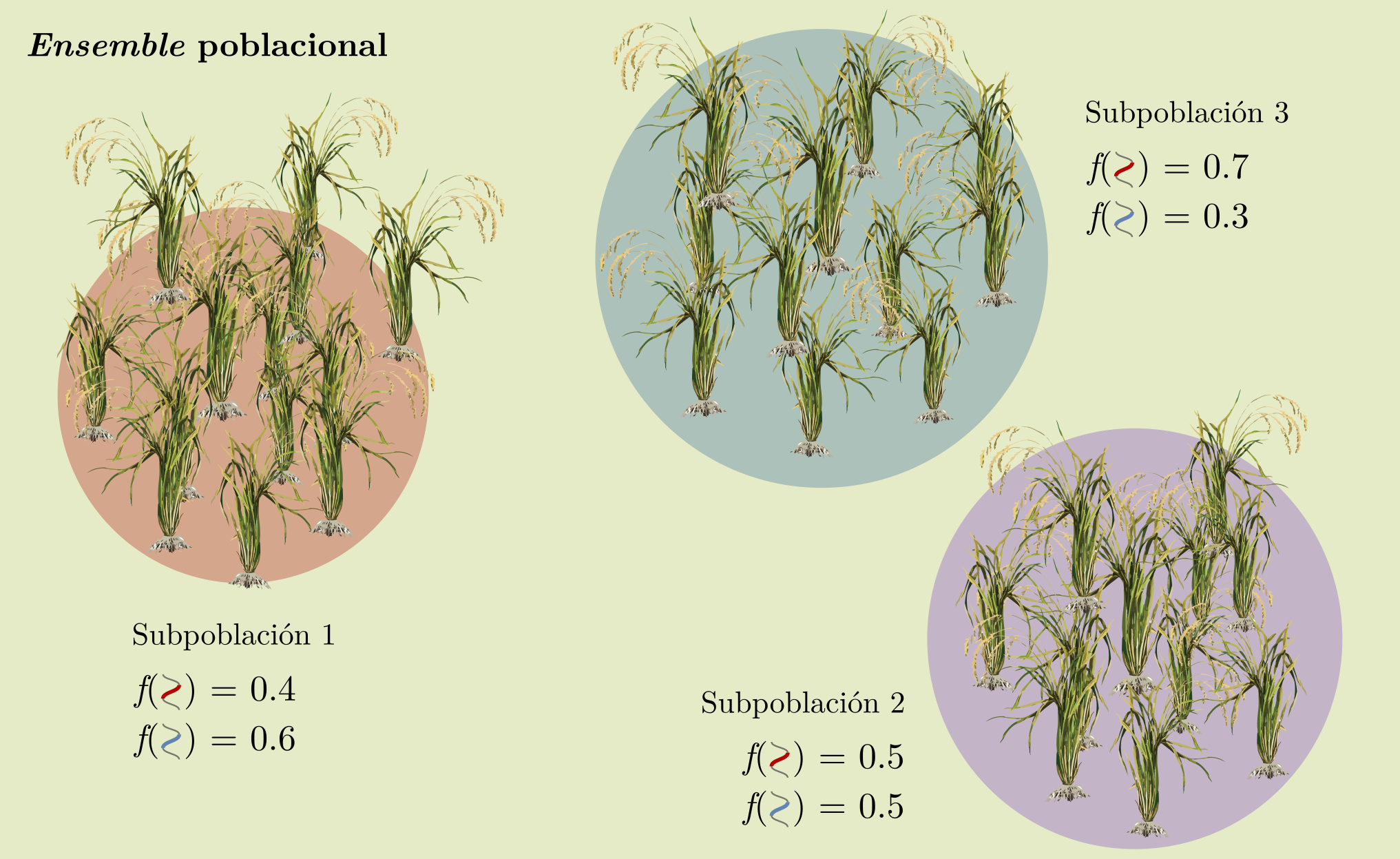

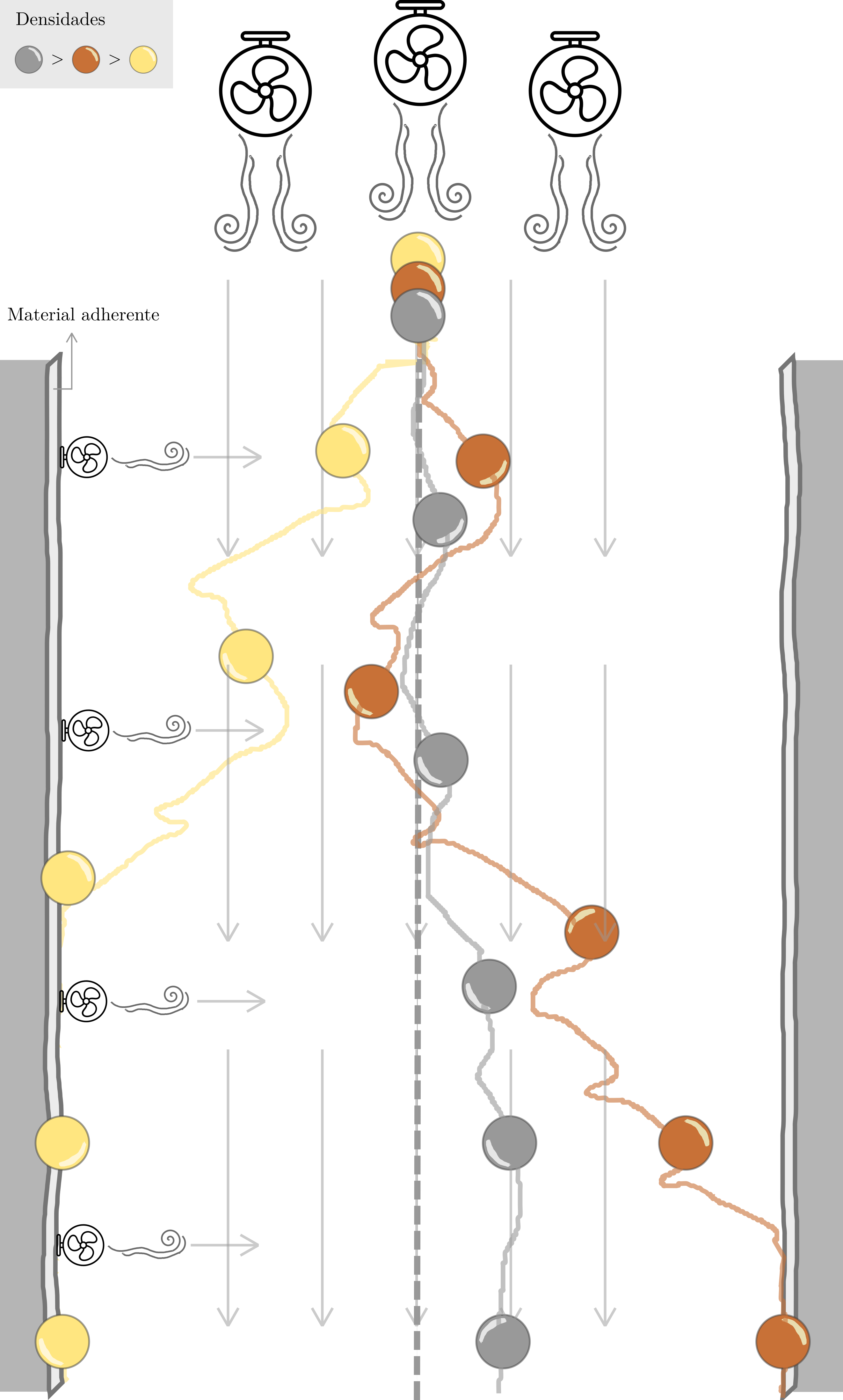

Pero veamos cómo podría estar funcionando la deriva genética en los procesos que llevan a la especiación. En efecto, imaginemos un locus con dos alelos que sean neutros respecto a los ambientes (por lo tanto no hay selección). Asumamos también que la tasa mutacional es suficientemente baja como para que resulte improbable la aparición de los mismos alelos. Supongamos también que se trata de una especie con poca movilidad esperada, o sea la relación entre su área potencial de apareamiento y el rango geográfico de la especie (pueden ser especies animales, plantas, hongos, por ejemplo). Si la dispersión a largas distancias en esta especie suele ser algo relativamente raro, por ejemplo semillas llevadas por el viento, es posible imaginar que el ensemble de poblaciones está formado por pequeños parches, cada uno constituyendo una población diferente y que dada la baja movilidad de la especie no es probable que intercambien material genético con otros parches (ver representación en la Figura 3.6).

Figura 3.6: Ejemplo de poblacional. Tres poblaciones de arroz () se encuentran distribuídas en parches, a distancias tales que los individuos de cada subpoblación sólo se reproducen entre sí. Por efecto de la deriva genética es esperable que las frecuencias alélicas de las subpoblaciones del ensemble diverjan con el tiempo, lo cual se ejemplifica para un locus bialélico (alelos “rojo” y “azul”, en la figura). Imagen creada con elementos gráficos tomados de bioicons (https://bioicons.com/).

Suponiendo además que el tamaño efectivo (\(N_e\)) es relativamente pequeño, algo muy razonable teniendo en cuenta que los individuos deben reproducirse en su entorno cercano, estamos entonces en una situación como alguna de las representadas en la Figura 3.5. Es decir, mientras que en algunos parches la frecuencia del alelo A crecerá hacia la fijación del mismo, en otras poblaciones posiblemente se pierda (o lo que es lo mismo, quede fijado el alelo a). Pero la deriva genética es un fenómeno que ocurre simultáneamente en todo el genoma (obviamente que en sitios no ligados del genoma el fenómeno es independiente) y por lo tanto aún las poblaciones que terminen con el alelo A fijado serán diferentes en otros loci, donde la deriva ocurre en forma independiente. Todo este proceso, dado simplemente por la “reglas” de la reproducción, producirá un conjunto de poblaciones cada vez más disimiles entre ellas (y cada vez más parecidas dentro), lo que es un buen comienzo para la especiación.

Un fenómeno usual en muchas especies, que magnifica el rol de la deriva genética, es lo que se conoce como cuello de botella poblacional (o “genetic bottleneck”, en inglés). En efecto, en muchas especies es frecuente encontrarse con eventos que llevan a la casi extinción de alguna población en particular, en un momento dado del tiempo, luego de lo cual la población comienza a recuperarse e incrementar el número de individuos. Sin embargo, las huellas de esta momentánea reducción drástica son normalmente imborrables en el genoma. Como en el momento de máxima restricción solo unos pocos individuos sobreviven (constituyendo la base reproductiva de la población a futuro), al ser \(N_e\) muy pequeño la varianza por generación será enorme, además de que la frecuencia inicial de las variantes será posiblemente sesgada respecto a la misma población antes del cuello de botella. Esto último nos lleva directamente a otro fenómeno estrechamente relacionado: el efecto fundador.

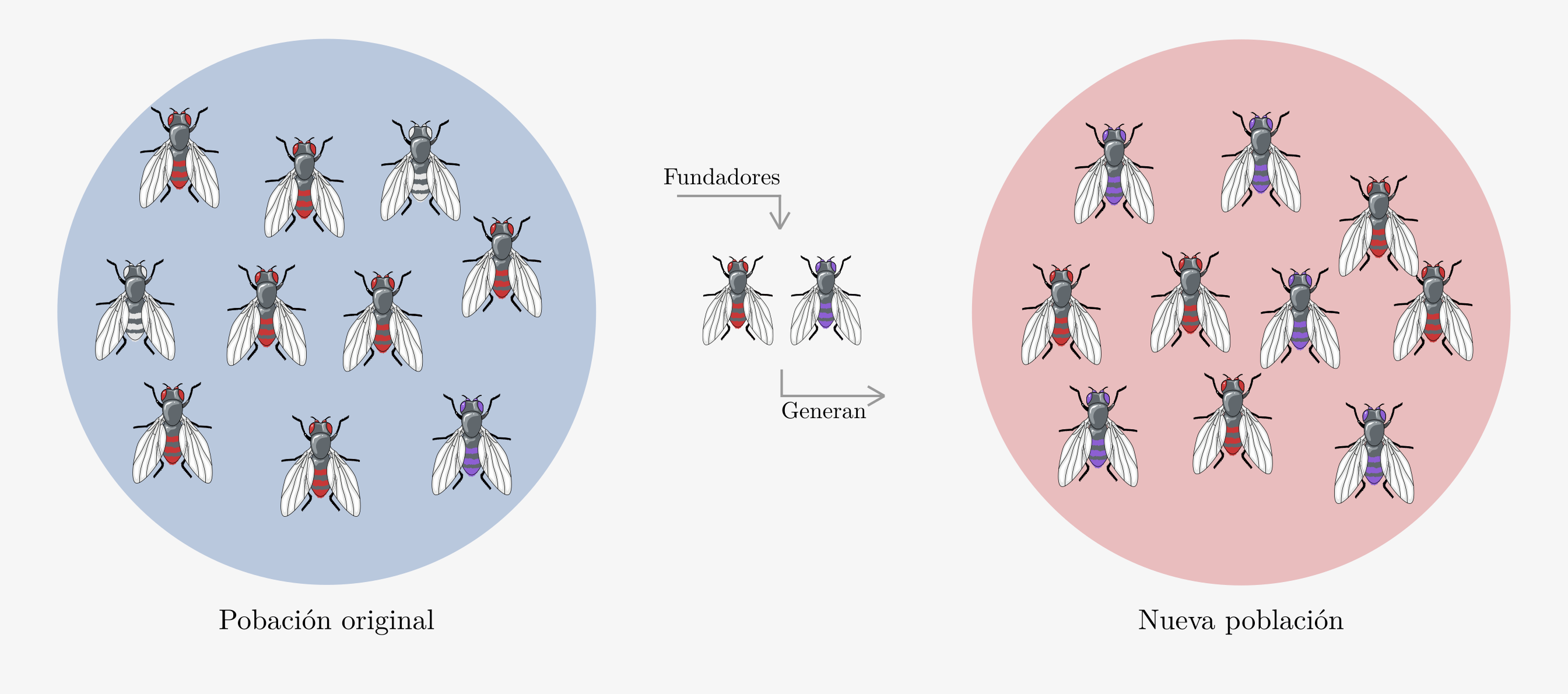

El efecto fundador (Figura 3.7) se produce cuando un número relativamente pequeño de individuos funda una nueva población y por efecto de la frecuencia sesgada en esa pequeña muestra más el efecto de la endogamia (o “inbreeding”, el efecto del apareamiento entre parientes que veremos en otro capítulo más adelante) casi obligada por el número reducido de individuos, llevan a medida de que la población va creciendo a una fuerte desviación de las frecuencias alélicas respecto a la población original.

Figura 3.7: Efecto fundador ejemplificado para una población de la mosca de la fruta (D. melanogaster). Cuando una nueva población es formada a partir de una muestra pequeña de individuos, las frecuencias alélicas presentes entre los individuos fundadores tendrán un fuerte impacto en el devenir de las frecuencias alélicas de la nueva población. Debido al efecto de muestreo, las frecuencia alélicas entre los miembros fundadores pueden apartarse considerablemente de las presentes en la población original. En el ejemplo vemos una población original de moscas que presentan diferentes fenotipos para el color de ojo (rojo, blanco y violeta), los cuales se asumen se deben a las variantes alélicas que presenta cada individuo en un locus. La muestra de individuos fundadores se encuentra fuertemente sesgada (la componen en igual proporción individuos con ojos rojos y violetas), lo cual lleva a que la nueva población fundada sea radicalmente diferente a la original. Imagen creada con elementos gráficos tomados de bioicons (https://bioicons.com/).

Un ejemplo notable entre poblaciones humanas lo constituye el pueblo de Cândido Godói, un municipio de Río Grande do Sul (Brasil) de unos 6 mil habitantes. El sobrenombre del pueblo es “Terra dos gêmeos” (tierra de los gemelos), ya que 1 de cada 10 mujeres ha tenido mellizos/gemelos, una cifra muy superior al 1,8% de Río Grande do Sul (y en algún estudio, cerca de la mitad fueron monocigóticos), Figura 3.8.

Figura 3.8: Mellizos/gemelos de Cândido Godoi (imagen sacada de la web, sin crédito de autor).

Si bien se especuló que el origen de este fenómeno serían una serie de experimentos del doctor nazi Josef Mengele, la causa más probable es el estrecho parentesco de sus habitantes, unido al efecto fundador como origen de la colonia (Tagliani-Ribeiro et al. 2011). En particular, en este estudio los autores encuentran una fuerte asociación entre la presencia del alelo P72 en el gen TP53 y el “riesgo” de embarazo gemelar. También los autores reportan una significancia menor para la asociación entre el alelo T del gen MDM4 y en conjunto proponen que ambos alelos (en dos genes distintos) estarían actuando mediante la reducción del mecanismo de apoptosis inducida por p53.

Homocigosidad y heterocigosidad

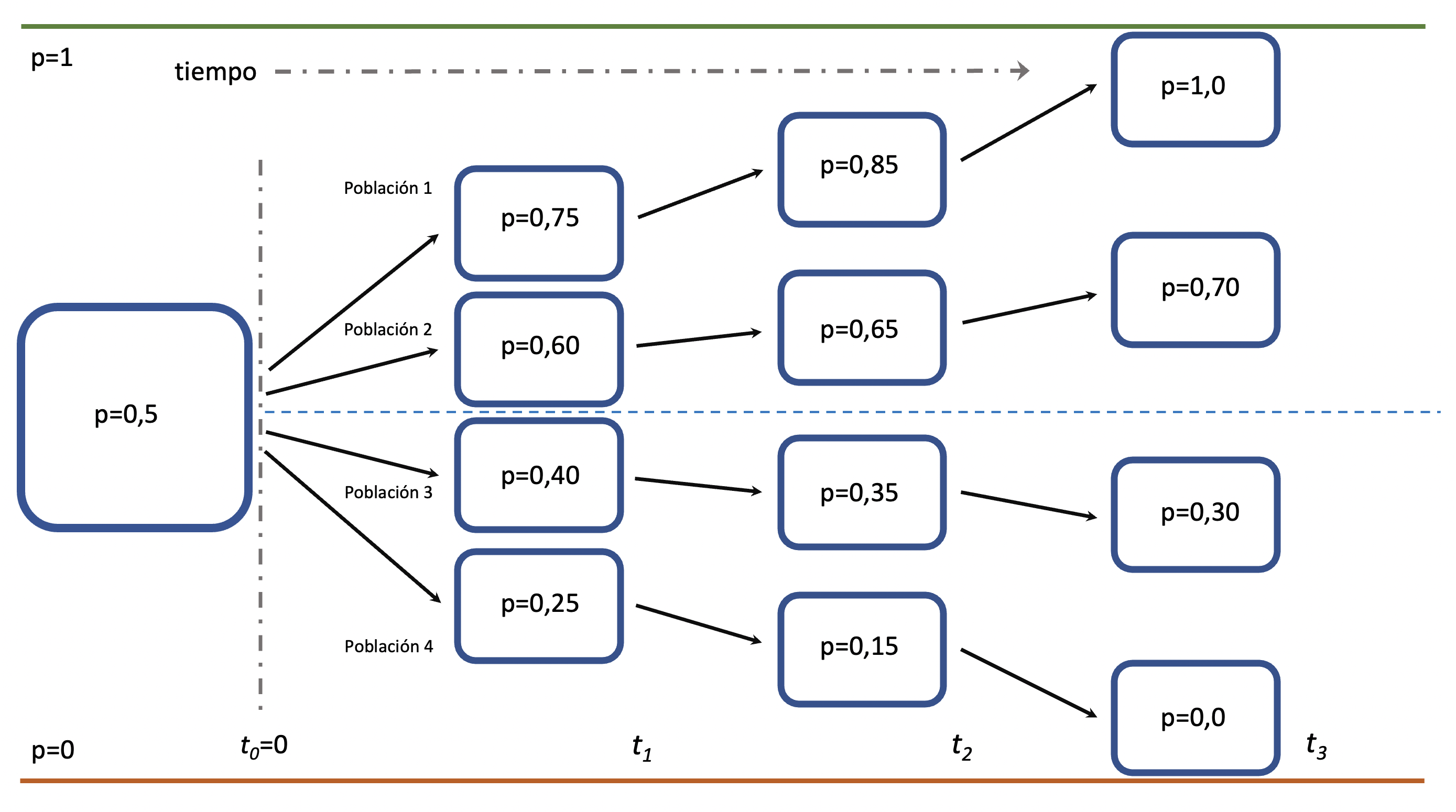

En las secciones anteriores nos hemos manejado considerando exclusivamente la evolución en el tiempo de las frecuencias alélicas en las distintas poblaciones que conforman nuestro ensemble y dejamos de lado el análisis de lo que ocurriría dentro y entre ellas desde el punto de vista de los genotipos. Consideremos, como una suposición a priori razonable, que dentro de cada población se mantiene el apareamiento al azar y que más allá del número posiblemente pequeño de individuos dentro de ellas que hacen fluctuar las frecuencias alélicas, podemos esperar que las mismas se comporten aproximadamente según lo esperado en el equilibrio de Hardy-Weinberg de generación en generación. Para graficar nuestra situación supongamos que tenemos una gran población, con una frecuencia del alelo A igual a \(p=\frac{1}{2}=0,5\) que en el momento inicial de nuestra historia se divide en 4 poblaciones idénticas en tamaño (cada una de \(1/4\) del tamaño de la grande), como lo representamos en la Figura 3.9. Cada una de estas poblaciones, a medida de que pase el tiempo, por efecto exclusivo de la deriva genética se irá apartando de la frecuencia original \(p=0,5\) y la varianza de frecuencias entre ellas irá creciendo en el tiempo, como vimos más arriba. Es de destacar que nuestra representación en la Figura 3.9 es apenas una configuración posible de infinitas, ya que la evolución de las 4 poblaciones será aleatoria, pero esta configuración en particular, sin pérdida de generalidad, nos ayudará a ilustrar el fenómeno general.

Figura 3.9: Evolución por deriva genética de las frecuencias alélicas en 4 subpoblaciones que parten de la misma frecuencia (el tiempo no está a escala). Las líneas superior e inferior representan las extbf{barreras absorbentes} de fijación y pérdida del alelo. A medida que corre el tiempo las poblaciones se apartan de la frecuencia alélica inicial, aunque se mantiene la frecuencia promedio como el valor inicial.

Si pensamos en la población original, antes de la subdivisión y asumimos que se encontraba en equilibrio de Hardy-Weinberg, ya que \(q=1-p=1-\frac{1}{2}=\frac{1}{2}\), tenemos que la composición de los tres genotipos era la siguiente:

\[ \begin{split} AA=p^2=\left(\frac{1}{2}\right)^2=\frac{1}{4}\\ Aa=2pq=2 \cdot \frac{1}{2} \frac{1}{2}=2 \cdot \frac{1}{4}=\frac{1}{2}\\ aa=q^2=\left(\frac{1}{2}\right)^2=\frac{1}{4} \end{split} \]

Luego, con el paso del tiempo, llegamos a un determinado momento \(t_1\) en que las frecuencias alélicas ya han divergido algo. En la Tabla ?? podemos ver lo que ocurre a nivel de los genotipos en cada una de las 4 poblaciones, así como la media de las 4 poblaciones (que como son todas iguales en tamaño es directamente igual al promedio de los valores). En la última columna tenemos también la frecuencia de los genotipos homocigotos, es decir AA y aa. Claramente, la frecuencia alélica promedio no ha cambiado, era de \(\frac{1}{2}\) en \(t_0=0\) y sigue siendo \(\frac{1}{2}\) en \(t_1\). Sin embargo, dentro de las poblaciones el cambio de frecuencia, sumado al equilibrio Hardy-Weinberg para cada una de ellas se refleja en diferencias importantes entre poblaciones en la proporción de homocigotos. Más aún, el promedio de los homocigotos (el promedio de la suma AA y aa en cada población) se vio incrementado, desde \(fr(AA)+fr(aa)=\frac{1}{4}+\frac{1}{4}=\frac{1}{2}=0,5\) a \(0,5725\). Este hecho no es menor: sin cambiar el promedio de las frecuencias alélicas y manteniendo el equilibrio de Hardy-Weinberg dentro de las poblaciones, si las volviésemos a agrupar a el solo efecto de contar los genotipos, el ensemble ya no se encuentra en el equilibrio de Hardy-Weinberg (porque el equilibrio para \(p=0,5\) es de \(G=\frac{1}{2}=0,5\)) 38.

| p | AA | Aa | aa | Homocigotos | |

|---|---|---|---|---|---|

| Población 1 | 0,75 | 0,5625 | 0,3750 | 0,0625 | 0,6250 |

| Población 2 | 0,60 | 0,3600 | 0,4800 | 0,1600 | 0,5200 |

| Población 3 | 0,40 | 0,1600 | 0,4800 | 0,3600 | 0,5200 |

| Población 4 | 0,25 | 0,0625 | 0,3750 | 0,5625 | 0,6250 |

| Media | 0,50 | 0,2862 | 0,4275 | 0,2862 | 0,5725 |

Veamos qué ocurre entonces a medida de que nos alejamos del punto inicial en el tiempo. Cuando llegamos al punto \(t_2\), las frecuencias en las poblaciones divergen un poco más, aunque ninguna población ha llegado aún a fijar alguno de los dos alelos. La distribución de los genotipos en las mismas, de acuerdo a las nuevas frecuencias alélicas, se puede apreciar en la Tabla ??. Claramente volvemos a ver un incremento en promedio de homocigotos en la población, que ahora alcanzó el valor \(0,6450\).

| p | AA | Aa | aa | Homocigotos | |

|---|---|---|---|---|---|

| Población 1 | 0,85 | 0,7225 | 0,255 | 0,0225 | 0,745 |

| Población 2 | 0,65 | 0,4225 | 0,455 | 0,1225 | 0,545 |

| Población 3 | 0,35 | 0,1225 | 0,455 | 0,4225 | 0,545 |

| Población 4 | 0,15 | 0,0225 | 0,255 | 0,7225 | 0,745 |

| Media | 0,50 | 0,3225 | 0,355 | 0,3225 | 0,645 |

Para ser breves y confirmar la tendencia observada (además de comenzar a imaginar hacia dónde nos lleva ésta), veamos qué ocurre en el instante \(t_3\). Llegado este momento, en la Población 1 se ha fijado el alelo A (\(p=1\)), mientras que en la Población 4 se ha fijado el alelo a (o lo que es equivalente, se ha perdido el A, \(p=0\)). La distribución de genotipos se observa en la Tabla ??.

| p | AA | Aa | aa | Homocigotos | |

|---|---|---|---|---|---|

| Población 1 | 1,0 | 1,000 | 0,00 | 0,000 | 1,00 |

| Población 2 | 0,7 | 0,490 | 0,42 | 0,090 | 0,58 |

| Población 3 | 0,3 | 0,090 | 0,42 | 0,490 | 0,58 |

| Población 4 | 0,0 | 0,000 | 0,00 | 1,000 | 1,00 |

| Media | 0,5 | 0,395 | 0,21 | 0,395 | 0,79 |

Ahora, además de haber aumentado nuevamente la proporción de homocigotos respecto al punto anterior en el tiempo, también tenemos un fenómeno nuevo: dos poblaciones solo tienen (y tendrán a futuro) genotipos homocigotos, ya que se ha fijado uno de los dos alelos. Todo esto ocurre sin cambiar la frecuencia alélica media del ensemble. Más aún, si recordamos el comportamiento de las frecuencias alélicas en el tiempo, tarde o temprano las poblaciones terminan cayendo en alguna de las dos “trampas” que son las barreras absorbentes, los estados de fijación o pérdida (fijación del otro alelo), por lo que este comportamiento de la Población 1 y Población 4 es también esperable para las otras dos poblaciones (veremos este fenómeno en detalle más adelante). Llegado ese momento ya no quedarán heterocigotos en el ensemble, pese a que la frecuencia alélica se mantiene como al inicio.

Para entender mejor y poder cuantificar este fenómeno de la reducción del número de heterocigotos debemos pasar a entender primero algunos conceptos sobre los que ahondaremos más adelante (ver capítulo Apareamientos no-aleatorios). Como vimos previamente, el concepto de alelo ha ido variando en el tiempo a medida de que nuestro conocimiento sobre la biología molecular y la genética han llevado a entender las bases de la variación genética. Sin embargo, hay un aspecto en que las cosas no han cambiado mucho: el origen de la similaridad o diferencia entre alelos. En ausencia de mutación39, cuando un alelo es diferente de otro en la presente generación, nos resulta obvio de dónde viene la diferencia: dos alelos son diferentes en esta generación porque provienen de diferentes alelos en la generación previa, y hay poca distinción más que agregar. Sin embargo, cuando dos alelos son “iguales” (decimos que es el mismo alelo) en la presente generación, podemos ser más precisos sobre el origen de esta similitud: los dos alelos “iguales” en la presente generación pueden provenir de dos alelos “iguales” en la generación previa, pero que no sean copias del mismo ADN que los generó, o pueden ser copias del mismo ADN (gametos del mismo individuo y del mismo cromosoma), en cuyo caso los llamamos idénticos por ascendencia. Este concepto es fundamental, así que asegúrate de haberlo entendido. En ambos casos, cuando los dos alelos son “iguales” independientemente del origen, decimos que son idénticos en estado. Claramente, excepto por mutaciones recurrentes en el tiempo, si nos retrotraemos en el pasado lo suficiente, todos los alelos idénticos en estado deberían venir del mismo alelo original, y por lo tanto serían de alguna manera idénticos por ascendencia, por lo que el marco de referencia es fundamental para decidir a partir de cuando se comienza a hacer esta distinción.

La probabilidad de que los dos alelos en un individuo sean idénticos por ascendencia se simboliza comúnmente con la letra \(F\), a partir de Sewall Wright (1922), que lo llamó coeficiente de fijación. Nosotros vamos a utilizar un subíndice para denotar el tiempo desde la generación \(0\), que consideramos la generación inicial. Supongamos que queremos calcular la probabilidad de que dos alelos sean idénticos por ascendencia en la generación \(t\), es decir \(F_t\).

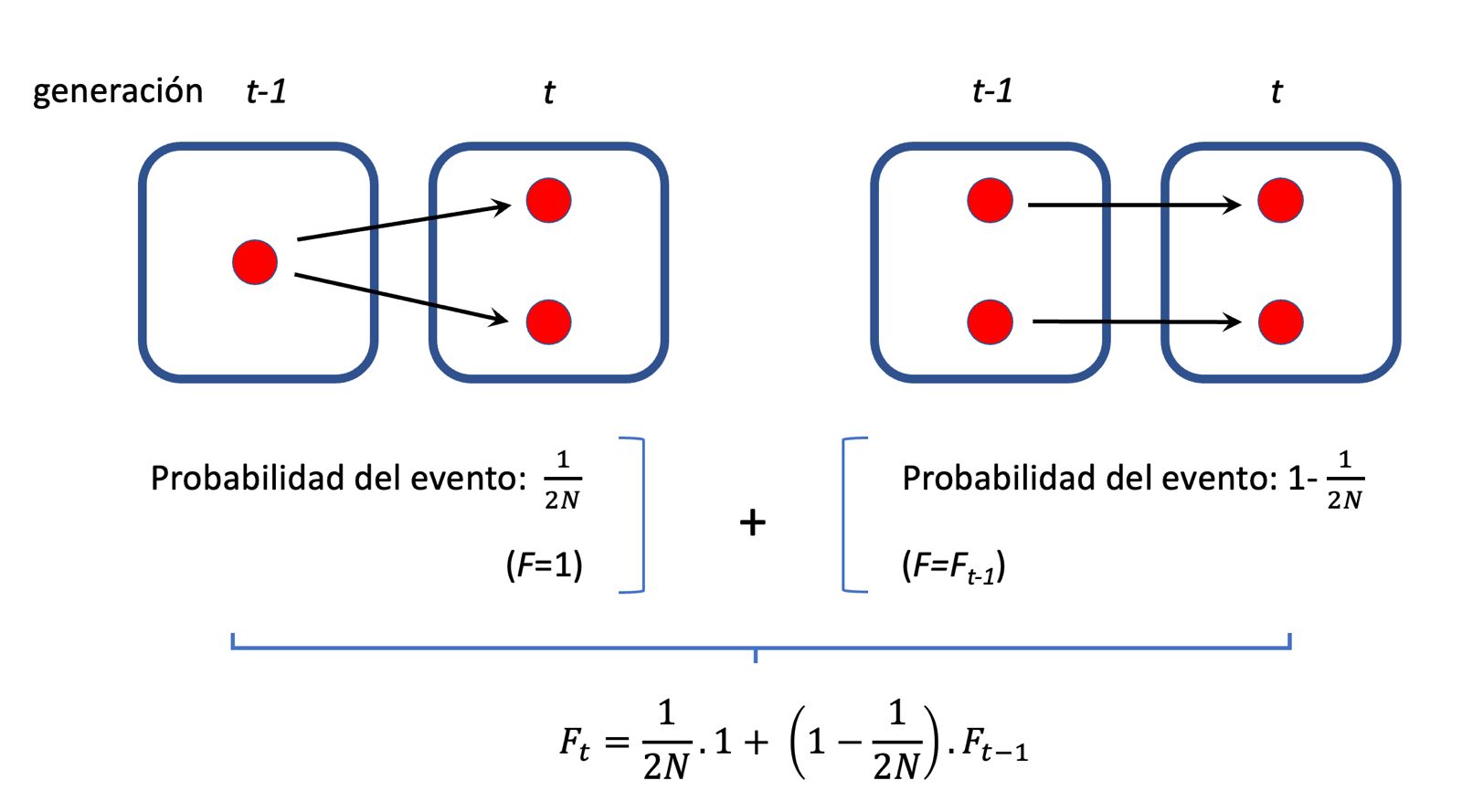

Figura 3.10: Ilustración del razonamiento detrás de la recursión para F en una población de tamaño finito. Existen dos alternativas disjuntas (de ahí la suma) para que un alelo sea idéntico por ascendencia en la generación t: que los alelos provengan del mismo alelo en la generación t-1, cuya probabilidad es \(\frac{1}{2N}\) (y en ese caso \(F=1\), por definición) o que los alelos provengan de distintas copias en la generación t-1, y en cuyo caso la probabilidad de que sean idénticos por ascendencia es por definición \(F_{t-1}\). Por lo tanto, la probabilidad de que dos alelos sean idénticos por ascendencia en la generación \(t\), considerando a la generación \(t-1\), es de \(F_t=\frac{1}{2N}+\left(1-\frac{1}{2N}\right) F_{t-1}\). Aplicando este razonamiento a las sucesivas generaciones anteriores se puede obtener, por recursión, la probabilidad de que dos alelos sean ídénticos por ascendencia a tiempo \(t\) (tomando como referencia la población a tiempo \(t=0\)).

Como se ilustra en la Figura 3.10, existen dos posibilidades mutuamente excluyentes para que dos alelos sean idénticos por ascendencia en la generación \(t\): a) que los dos alelos provengan del mismo alelo en la generación \(t-1\), un evento cuya probabilidad es \(\frac{1}{2N}\) (ya que hay \(2N\) alelos en la población y por lo tanto la probabilidad de volver a muestrear el mismo es \(\frac{1}{2N}\)) y en ese caso \(F=1\), ya que al venir del mismo alelo este es idéntico por ascendencia a sí mismo con probabilidad de 1, y b) que los alelos provengan de distintas copias en la generación \(t-1\), y en ese caso la probabilidad de que sean idénticos por ascendencia es por definición \(F_{t-1}\). Como se trata de dos eventos disjuntos (puede pasar uno u otro, pero no los dos a la vez), puedo sumar sus probabilidades para tener

\[\begin{equation} F_t=\frac{1}{2N}+\left(1-\frac{1}{2N}\right)F_{t-1} \tag{3.5} \end{equation}\]

Se puede calcular así la probabilidad de dos alelos sean idénticos por ascendencia en una generación, asumiendo que se conoce dicha probabilidad para la generación anterior. Veamos ahora si podemos llegar a una expresión general para la probabilidad de dos alelos sean idénticos por ascendencia en una generación basado en el número de generaciones transcurridas desde un momento de referencia (\(t=0\)) y la probabilidad inicial \(F_0\) en dicho momento. Si a ambos lados de la ecuación (3.5) multiplicamos por \(-1\) y le sumamos \(1\) 40 tenemos

\[\begin{equation} 1-F_t=1-\frac{1}{2N}-(1-\frac{1}{2N}) F_{t-1} 1-F_t=(1-\frac{1}{2N})(1-F_{t-1}) \tag{3.6} \end{equation}\]

Pero con la misma lógica,

\[\begin{equation} 1-F_{t-1}=\left(1-\frac{1}{2N}\right)(1-F_{t-2}) \tag{3.7} \end{equation}\]

y sustituyendo (3.7) en (3.6), tenemos

\[\begin{equation} 1-F_t=(1-\frac{1}{2N})(1-\frac{1}{2N})(1-F_{t-2})=(1-\frac{1}{2N})^2(1-F_{t-2}) \tag{3.8} \end{equation}\]

Prosiguiendo con la recursión hasta llegar a la generación \(0\) (generación inicial), como transcurren \(t\) generaciones entre la \(0\) y la actual tenemos que la ecuación (3.8) se generaliza a

\[\begin{equation} 1-F_t=\left(1-\frac{1}{2N}\right)^t(1-F_{0}) \tag{3.9} \end{equation}\]

Más aún, si asignamos arbitrariamente \(F_0=0\) por falta de conocimiento acerca de la probabilidad de que dos alelos sean idénticos por ascendencia en la generación inicial, entonces la ecuación (3.9) se transforma en

\[\begin{equation} 1-F_t=\left(1-\frac{1}{2N}\right)^t \end{equation}\]

\[\begin{equation} F_t=1-\left(1-\frac{1}{2N}\right)^t \tag{3.10} \end{equation}\]

Veamos ahora cómo se relaciona todo esto con el problema de la subdivisión poblacional planteado en la Figura 3.9. Por definición, \(F\) es también la reducción en heterocigosis (o el incremento en homocigosis) respecto a la expectativa en equilibrio de Hardy-Weinberg (y sus frecuencias genotípicas) en poblaciones finitas (porque es la probabilidad de que dos alelos sean idénticos por ascendencia en un individuo, por lo tanto homocigoto). Entonces, el paralelismo de \(1-F\) es respecto a los heterocigotos conservados y el apareamiento aleatorio. Si consideramos que la frecuencia esperada de heterocigotas en una población de tamaño finito es una función de \(p\) y \(q\), pero también de esa probabilidad de que los alelos no sean idénticos por ascendencia, entonces si llamamos \(H_t\) a esa frecuencia, tenemos,

\[ \begin{split} H_t=2pq(1-F_{t-1})\\ \therefore 1-F_{t-1}=\frac{H_t}{2pq} \end{split} \]

El \(t-1\) en el término \((1-F_{t-1})\) se corresponde con el hecho de que el efecto de la reducción de los pares de alelos NO idénticos por ascendencia se ve en la generación anterior a la presente. Notemos que \(H_t = 2pq(1-F_{t-1})\), lo cual equivale a decir \(1-F_{t-1} = \frac{H}{2pq}\). Esto nos lleva a

\[ \begin{split} 1-F_t=\left(1-\frac{1}{2N}\right)(1-F_{t-1})=\left(1-\frac{1}{2N}\right)\frac{H_t}{2pq}= \\ =\left(1-\frac{1}{2N}\right)^2\frac{H_{t-1}}{2pq}=\left(1-\frac{1}{2N}\right)^3\frac{H_{t-2}}{2pq} \\ \therefore \left(1-\frac{1}{2N}\right)\frac{H_t}{2pq}=\left(1-\frac{1}{2N}\right)^{t+1}\frac{H_{t-t}}{2pq} \\ H_t=\left(1-\frac{1}{2N}\right)^t H_0= \left(1-\frac{1}{2N}\right)^t[2pq(1-F_{-1})] \end{split} \]

Notemos que en el desarrollo anterior se continuó la recursión planteada hasta alcannzar el tiempo \(t=t\) (de ahí que el exponente que acompaña a \(H_{t-t} = H_0\) sea \(t+1\)). Luego, como en ambos lados de la ecuación se tiene \(2pq\) en el denominador, los términos se cancelan, y como en el lado izquierdo se tiene \(1-\frac{1}{2N}\), al dividir ambos lados por este término el exponente \(t+1\) en el lado derecho pasa a ser \(t\).

En resumen, luego de este desarrollo por recursión se llega a

\[ H_t = (1 - \frac{1}{2N})^t H_0 \tag{3.11} \]

Utilizando la aproximación \((1-a)^b \approx (e^{-a})^b \approx e^{-ab}\) cuando \(a \to 0\) (en nuestro caso, \(a = \frac{1}{2N};\ b = t\)), tenemos

\[\begin{equation} H_t=\left(1-\frac{1}{2N}\right)^t H_0 \approx H_0 e^{\frac{-t}{2N}} \tag{3.12} \end{equation}\]

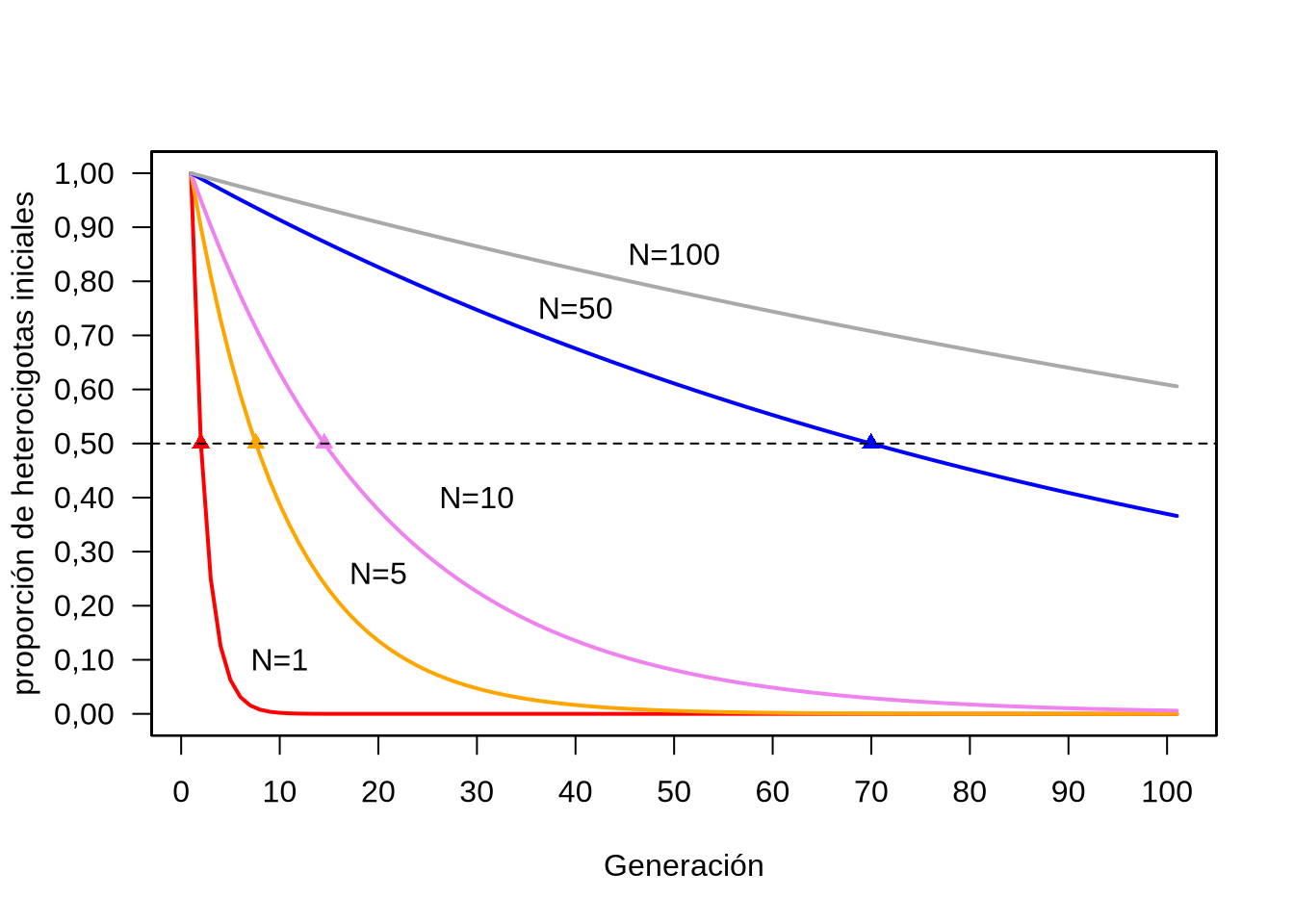

Es decir, pese a que en cada una de las poblaciones se mantiene el equilibrio de Hardy-Weinberg, como se puede apreciar en la Figura 3.11, la proporción de individuos heterocigotos en el conjunto de ellas, o mejor dicho el promedio en el ensemble, decaerá en forma geométrica respecto al valor inicial a lo largo del tiempo ya que la proporción en cada generación es multiplicada por el factor \(\left(1-\frac{1}{2N}\right)\) al pasar a la siguiente. La aproximación exponencial funciona en general razonablemente bien, y permite resolver algunos problemas en forma más sencilla. El efecto de la reducción en la proporción de heterocigotos es realmente drástico cuando los tamaños poblacionales son extremadamente pequeños, por ejemplo \(N=5\) o \(N=10\) individuos en la Figura 3.11, pero son apenas notables cuando el número de individuos es 50 o más (notar que para 100 individuos el punto de reducción a \(50\%\) de la heterocigosis inicial ni siquiera aparece en la gráfica, ya que llevaría más de 138 generaciones para alcanzarlo).

Figura 3.11: Reducción esperada en el número inicial de heterocigotas \(H_0\) de acuerdo al tamaño N de las poblaciones y al número de generaciones transcurridas. La línea negra horizontal marca la reducción a la mitad del valor inicial y los puntos sobre las curvas resaltan el número de generaciones requeridas para esa reducción a la mitad.

Ejemplo 3.2

La ecuación (3.12), en particular la aproximación exponencial, nos permite estimar facilmente los tiempos hasta determinado nivel de reducción de la frecuencia inicial de heterocigotos. Por ejemplo, para alcanzar la mitad del valor inicial (\(H_0\)), con poblaciones de \(N\) individuos puedo hacer \(H_t=\frac{H_0}{2}\). Luego, de acuerdo a la ecuación (3.12) tenemos que

\[ \begin{split} H_t=\frac{H_0}{2}=H_0e^{\frac{-t}{2N}}\\ \therefore \frac{1}{2}=e^{\frac{-t}{2N}} \end{split} \]

Aplicando el logaritmo a ambos lados de la ecuación, tenemos

\[\begin{equation*} \ln\left(\frac{1}{2}\right)=\ln\left(e^{\frac{-t}{2N}}\right)=\frac{-t}{2N} \end{equation*}\]

y finalmente

\[\begin{equation*} t=-2N \ln\left(\frac{1}{2}\right) \approx 1,39N \end{equation*}\]

Es decir, en \(1,39N\) generaciones. Si lo hubiésemos hecho sin la aproximación, el procedimiento es análogo y llegaríamos a

\[\begin{equation*} \frac{H_0}{2}=\left(1-\frac{1}{2N}\right)^t H_0 \therefore t=\frac{\ln{\left(\frac{1}{2}\right)}}{\ln{\left(1-\frac{1}{2N}\right)}} \end{equation*}\]

que si bien es la solución exacta, no es lineal en el número de individuos en cada población.

Resumiendo, en esta sección vimos cómo la subdivision poblacional produce el efecto de disminuir el número de heterocigotas respecto a los esperado para las poblaciones del ensemble agregadas en un solo grupo y bajo condiciones de panmixia (es decir, con libertad de aparearse con cualquier otro individuo de la población, sin restricciones genéticas, conductuales o ambientales). Esa disminución de la proporción de heterocigotos esperados ocurre a una tasa constante por generación (en nuestro modelo) y la misma es de \(\left(1-\frac{1}{2N}\right)\), por lo que la reducción total a lo largo de \(t\) generaciones será del orden de \(\left(1-\frac{1}{2N}\right)^t\). Mientras que en la sección El modelo de Wright-Fisher construimos un modelo de evolución de las frecuencias alélicas sin preocuparnos de los genotipos, en esta sección vimos las implicancias para la evolución de los genotipos tiene dicho modelo. En la sección Cadenas de Markov veremos de otra forma una conexión entre los dos fenómenos utilizando una aproximación fundamental para comprender los procesos estocásticos en general.

PARA RECORDAR

- La recursión para el coeficiente de fijación \(F\) en la generación \(t\), \(F_t\) es igual a: \[\begin{equation*} 1-F_t=\left(1-\frac{1}{2N}\right)^t(1-F_0) \end{equation*}\]

- Cuando \(F_0=0\), es decir que asumimos que en la generación inicial la probabilidad de que dos alelos en un locus de un individuo diploide es cero, entonces la recursión anterior se simplifica a:

\[\begin{equation*} F_t=1-\left(1-\frac{1}{2N}\right)^t \end{equation*}\]

- El número de heterocigotos en un ensemble de poblaciones de tamaño finito \(N\) se ve reducido de generación en generación respecto a lo esperado para el equilibrio de Hardy-Weinberg. Esa reducción es a la tasa de \(\left(1-\frac{1}{2N}\right)\) por generación, por lo que la frecuencia de heterocigotos en la generación \(t\) se calcula de acuerdo a la siguiente ecuación:

\[\begin{equation*} H_t=\left(1-\frac{1}{2N}\right)^t H_0 \approx H_0 e^{\frac{-t}{2N}} \end{equation*}\]

3.4 Cadenas de Markov

Si recuerdas la ecuación (3.2) de más arriba establecía la probabilidad de transición de un número \(i\) de copias a un número \(j\) (en un total de \(2N\) alelos) en una generación, y la misma era igual a:

\[\begin{equation} T_{ij}={2N \choose j}\left(\frac{i}{2N}\right)^{j}\left(\frac{2N-i}{2N}\right)^{2N-j}=\frac{(2N)!}{j!(2N-j)!}p^jq^{2N-j} \tag{3.13} \end{equation}\]

Visto de otra forma, como \(i\) puede ir desde \(0\) hasta \(2N\) y lo mismo para \(j\), podemos poner estas probabilidad de transición en una matriz cuadrada con \(2N+1\) filas y \(2N+1\) columnas (el \(+1\) es debido a que un conteo de \(0\) para cada alelo es posible). Por ejemplo, calculemos la matriz para una población con 2 individuos diploides. Para ello vamos a calcular en forma explícita las probabilidades de transición de unas pocas celdas de la matriz y el resto sigue la misma lógica. En particular, vamos a calcular algunas celdas de la fila correspondientes a 2 alelos A en la generación actual (o sea \(p=\frac{2}{4}=\frac{1}{2}=0,5\)). Estas celdas corresponden a la probabilidad de pasar de un número \(i=2\) de alelos A a un número \(j\) determinado en la próxima generación.

De acuerdo a la ecuación (3.13), la probabilidad de transición de 2 copias del alelo A (\(i=2\)) a 1 copia del mismo (\(j=1\)) es de:

\[\begin{equation} T_{2,1}={4 \choose 1}\left(\frac{2}{4}\right)^{1}\left(\frac{4-2}{4}\right)^{4-1}={4 \choose 1}\left(\frac{1}{2}\right)^{1}\left(\frac{1}{2}\right)^{3}=4 \left(\frac{1}{2}\right)^4=0,25 \end{equation}\]

Asimismo, la probabilidad de transición de 2 copias del alelo A (\(i=2\)) a 3 copias del mismo (\(j=3\)) es de:

\[\begin{equation} T_{2,3}={4 \choose 3}\left(\frac{2}{4}\right)^{3}\left(\frac{4-2}{4}\right)^{4-3}={4 \choose 3}\left(\frac{1}{2}\right)^{3}\left(\frac{1}{2}\right)^{1}=4 \left(\frac{1}{2}\right)^4=0,25 \end{equation}\]

De la misma manera, la probabilidad de transición de 2 copias del alelo A (\(i=2\)) a 4 copias del mismo (\(j=4\)) es de:

\[\begin{equation} T_{2,4}={4 \choose 4}\left(\frac{2}{4}\right)^{4}\left(\frac{4-2}{4}\right)^{4-4}={4 \choose 4}\left(\frac{1}{2}\right)^{4}\left(\frac{1}{2}\right)^{0}=1 \left(\frac{1}{2}\right)^4=0,0625 \end{equation}\]

En la tabla ?? puedes ver el resultado de calcular las probabilidades de transición para todos los pares de estados posibles (pares entrada-salida, o generación actual-próxima generación, \(0 \leq i \leq 2N\), \(0 \leq j \leq 2N\)). Llamaremos a esta matriz \(T\), por ser la matriz de probabilidad de transiciones de estado. En las filas tenemos los posibles estados en la generación actual, definidos como el número de alelos A en la generación actual, mientras que en las columnas tenemos el número de alelos A en la generación próxima. Se trata de probabilidades, ya que lo visto hasta ahora es que el apareamiento de acuerdo al modelo de Wright-Fisher generará poblaciones descendientes en forma aleatoria, con una probabilidad dada por esta matriz de transición. Es de notar que los estados actuales de 0 y 4 alelos A se corresponden a lo que definimos como barreras absorbentes de nuestro sistema, pues una vez alcanzado alguno de estos dos estados será imposible abandonarlos (estamos asumiendo la ausencia de mutación). Dicho de otra forma, una vez que se pierde el alelo A en una población (\(0\) copias del mismo), o que el mismo queda fijado en la población (\(2N\) copias, en nuestro ejemplo \(2N=4\) copias), en las próximas generaciones esto no va a cambiar.

| a 0 alelos A | a 1 alelos A | a 2 alelos A | a 3 alelos A | a 4 alelos A | |

|---|---|---|---|---|---|

| de 0 alelos A | 1,0000 | 0,0000 | 0,0000 | 0,0000 | 0,0000 |

| de 1 alelos A | 0,3164 | 0,4219 | 0,2109 | 0,0469 | 0,0039 |

| de 2 alelos A | 0,0625 | 0,2500 | 0,3750 | 0,2500 | 0,0625 |

| de 3 alelos A | 0,0039 | 0,0469 | 0,2109 | 0,4219 | 0,3164 |

| de 4 alelos A | 0,0000 | 0,0000 | 0,0000 | 0,0000 | 1,0000 |

¡Excelente! Tenemos computada nuestra matriz de transiciones. Si observas con cuidado verás que la suma de cada fila es igual a 1, es decir \(\sum_{j=0}^{2N} p_{i,j}=1\). Esto quiere decir que las poblaciones que parten de \(i\) alelos en la generación padre deben distribuirse entre todas las posibilidades \(j\), pero que en última instancia, al tratarse de un probabilidad, la suma de todas las posibilidades disjuntas debe ser igual a 1. Veamos ahora cómo la podemos usar para calcular la evolución de las frecuencias alélicas en un ensemble de poblaciones, todas del mismo tamaño y que parten de la misma frecuencia alélica. Supongamos que todas estas poblaciones parten en tiempo \(t=0\) de \(i=2\) alelos A. Representaremos las frecuencia de poblaciones en las que hay \(i\) alelos con un vector de largo \(2N+1\); la primera posición en el vector representará la frecuencia de poblaciones con 0 alelos A, la segunda la frecuencia de poblaciones con 1 alelo A, la tercera con 2 alelos AA, y así hasta la posición \(2n+1=5\) en nuestro caso. Como todas las poblaciones arrancan desde \(i=2\), nuestro vector de frecuencias será \(\mathbf{I}_0=(0;0;1;0;0)\). Ahora, si multiplicamos este vector fila \(\mathbf{I}_0\) por nuestra matriz \(\mathbf{T}\) de transiciones (si precisas recordar como se multiplican matrices y vectores, recurre al [APENDICE A: Conceptos Matemáticos Básicos]), obtendremos un nuevo vector de probabilidad de que las distintas poblaciones del ensemble posean un número determinado de alelos A, dado por \(\mathbf{I}_1=\mathbf{I}_0 * \mathbf{T}\) (representado en la Tabla ??).

| 0 alelos A | 1 alelos A | 2 alelos A | 3 alelos A | 4 alelos A |

|---|---|---|---|---|

| 0,0625 | 0,25 | 0,375 | 0,25 | 0,0625 |

Es decir, si bien partimos de que todas las poblaciones poseían 2 alelos A, por efecto del azar (deriva genética le llamamos a este efecto), ahora un \(6,25\%\) de ellas poseerán 0 alelos A (se habrá perdido el mismo), un \(25\%\) 1 alelo A, un \(37,5\%\) 2 alelos A, otro \(25\%\) 3 alelos A y finalmente, \(6,25\%\) de ellas tendrán todos los 4 alelos A (habrán fijado ese alelo). Ahora, la misma matriz de transición que aplicamos para pasar de la generación \(t=0 \to t=1\) la podemos aplicar al vector de probabilidades (frecuencias relativas) de poblaciones en la generación \(t=1\) para pasar a la \(t=2\). 41 Es decir que ahora tenemos \(\mathbf{I}_2=\mathbf{I}_1 * \mathbf{T}\), cuyo resultado podemos apreciar en ??.

| 0 alelos A | 1 alelos A | 2 alelos A | 3 alelos A | 4 alelos A |

|---|---|---|---|---|

| 0,166 | 0,2109 | 0,2461 | 0,2109 | 0,166 |

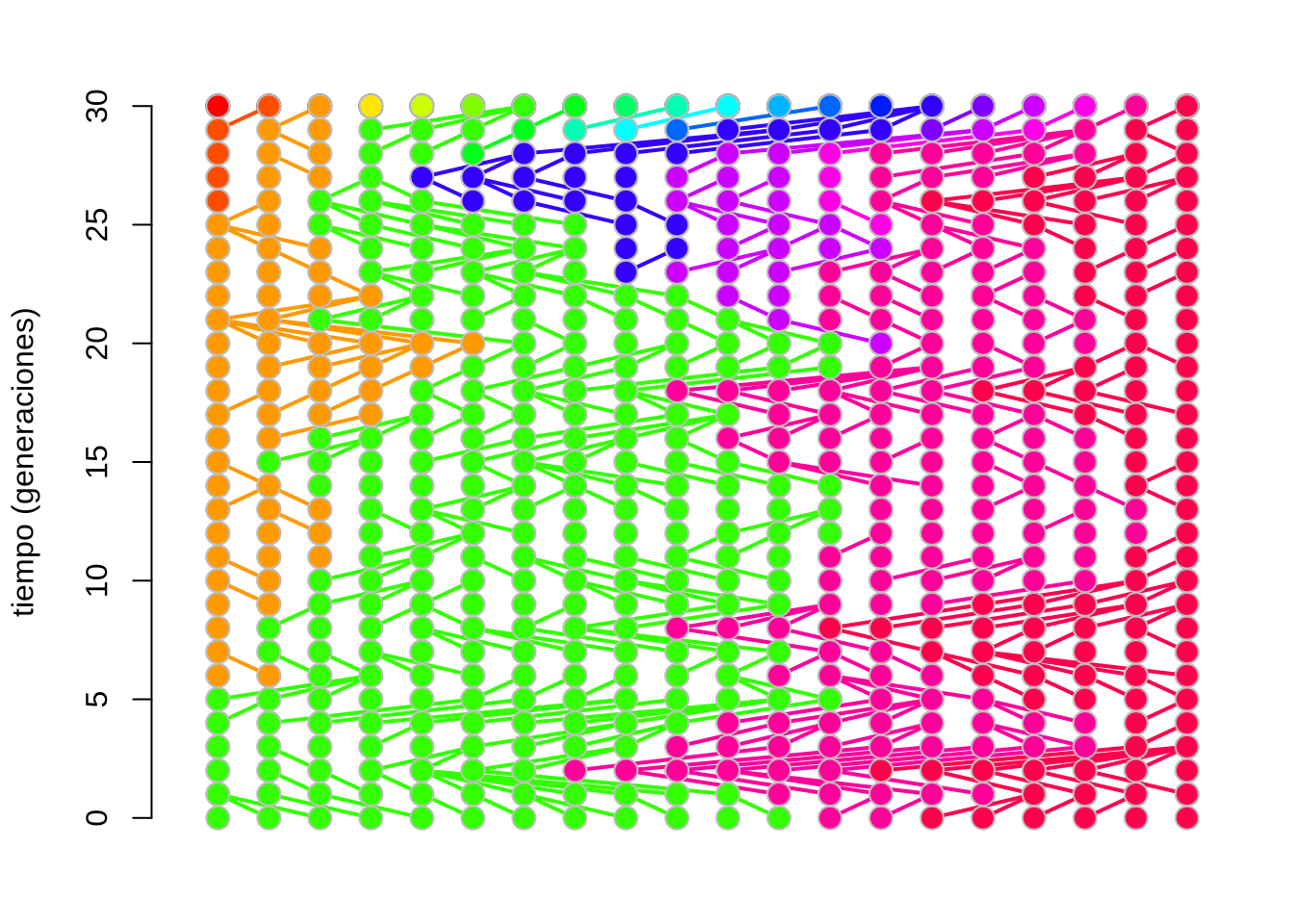

Podemos repetir este procedimiento de generación en generación. Cuando un proceso estocástico depende solamente del estado inmediantamente anterior en el tiempo, como en nuestro caso, decimos que se trata de un proceso Markoviano. Una cadena de Markov42 es una secuencia de eventos (usualmente en el tiempo) en la que cada resultado depende exclusivamente del resultado precedente. Dicho de otra manera, para predecir el siguiente resultado del proceso (futuro) solo la información del presente estado es relevante y el pasado (los estados anteriores del sistema) no tienen relevancia. A esto último se le conoce como propiedad markoviana (o de falta de memoria). En nuestro caso, como la distribución de probabilidades de cada nueva generación \(t=k\) es determinada multiplicando el resultado de la anterior (\(\mathbf{I}_{t=(k-1)}\)) por la matriz de transición (\(\mathbf{T}\)), claramente podemos ver por qué se trata de una cadena (de Markov). Si comparamos la evolución de nuestro sistema, tenemos ahora que desde la generación \(t=0\) hasta la generación \(t=5\), la frecuencias han ido cambiando de la manera que se aprecia en la Tabla ??.

| 0 alelos A | 1 alelos A | 2 alelos A | 3 alelos A | 4 alelos A |

|---|---|---|---|---|

| 0,0000 | 0,0000 | 1,0000 | 0,0000 | 0,0000 |

| 0,0625 | 0,2500 | 0,3750 | 0,2500 | 0,0625 |

| 0,1660 | 0,2109 | 0,2461 | 0,2109 | 0,1660 |

| 0,2490 | 0,1604 | 0,1813 | 0,1604 | 0,2490 |

| 0,3117 | 0,1205 | 0,1356 | 0,1205 | 0,3117 |

| 0,3587 | 0,0904 | 0,1017 | 0,0904 | 0,3587 |

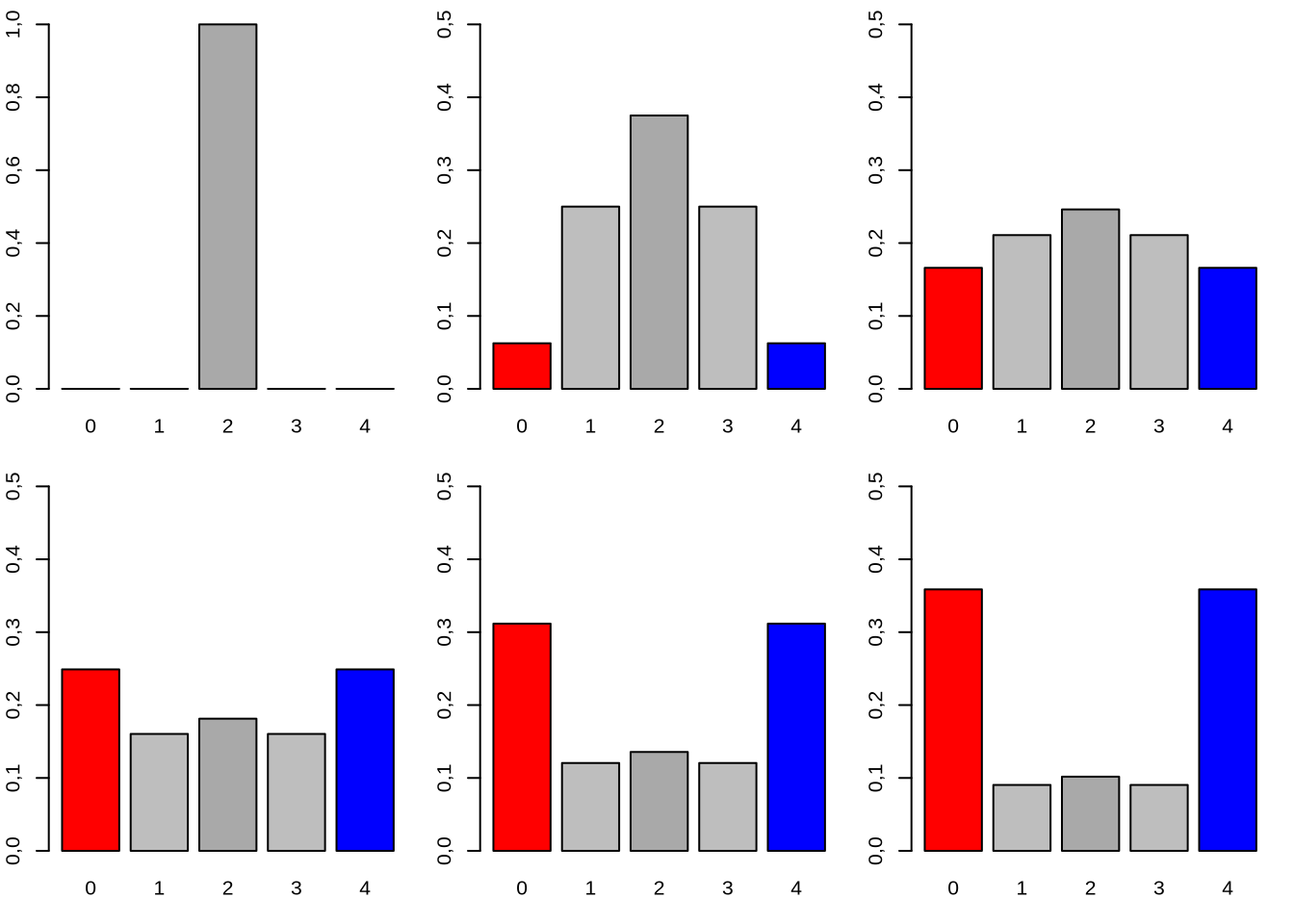

Otra forma de verlo, más gráfica, aparece en la Figura 3.12. Claramente se aprecia que mientras que las probabilidades de encontrarse en los estados intermedios (\(i=1\) a \(i=3\), en gris) decrece, la de los estados correspondientes a las barreras absorbentes (rojo: pérdida, azul: fijación) crece en la misma medida. La pregunta sería ¿hacia dónde va este movimiento?, o dicho de otra forma, ¿qué ocurre si seguimos de generación en generación?

Antes de abordar esta cuestión, es interesante notar que \(\mathbf{I}_2=\mathbf{I}_1 * \mathbf{T} = (\mathbf{I}_0 * \mathbf{T}) * \mathbf{T} = \mathbf{I}_0 * (\mathbf{T} * \mathbf{T})=\mathbf{I}_0 * \mathbf{T}^2\)43. Claramente, lo anterior se puede generalizar a \(\mathbf{I}_{t=k}=\mathbf{I}_0 * \mathbf{T}^{(k)}\). En palabras, para calcular la distribución de probabilidades de los estados (número de alelos A en nuestro ensemble de poblaciones) en cualquier generación \(k\) (donde consideramos \(t=k\), \(k>0\)) basta con multplicar la distribución en la generación inicial (o sea en \(t=0\), que llamamos \(\mathbf{I}_0\)) por la matriz de transición de probabilidades elevada a la potencia \(k\).

Figura 3.12: Evolución de la probabilidad de encontrar a las poblaciones en un estado alélico determinado desde la generación \(t=0\) a \(t=5\) (desde el costado superior izquierdo al inferior derecho). En rojo el estado de 0 alelos A (pérdida del mismo), en azul 4 alelos A (fijación del mismo) y en gris oscuro 2 alelos (nuestro punto de partida en todas las poblaciones). Notar la diferente escala de la generación \(t=0\) al resto.

Volvamos entonces a la pregunta anterior: ¿hacia dónde va el movimiento de las frecuencias en las distintas poblaciones a largo plazo? Para abordar esta cuestión, tendremos en cuenta el razonamiento de que \(\mathbf{I}_{t=k}=\mathbf{I}_0 * \mathbf{T}^{(k)}\). Resulta interesante ver cómo se comporta \(\mathbf{T}^{(k)}\) cuando \(k \to \infty\), es decir cuando el número de generaciones tiende a infinito. Una aproximación numérica sencilla consiste en elevar \(\mathbf{T}\) a un número suficientemente grande (e.g 50 generaciones) y ver la forma que adquiere la matriz, como aparece en la Tabla ??.

| a 0 alelos A | a 1 alelos A | a 2 alelos A | a 3 alelos A | a 4 alelos A | |

|---|---|---|---|---|---|

| de 0 alelos A | 1,00 | 0 | 0 | 0 | 0,00 |

| de 1 alelos A | 0,75 | 0 | 0 | 0 | 0,25 |

| de 2 alelos A | 0,50 | 0 | 0 | 0 | 0,50 |

| de 3 alelos A | 0,25 | 0 | 0 | 0 | 0,75 |

| de 4 alelos A | 0,00 | 0 | 0 | 0 | 1,00 |

Si miramos las columnas de la Tabla ?? podemos apreciar dos situaciones claramente distintas; en las columnas 2, 3 y 4 (que corresponden a pasar de una generación a la siguiente a los estados de 1, 2 y 3 alelos A respectivamente), todas las celdas son 0, es decir más allá del punto de arranque (el vector de frecuencias o probabilidades \(\mathbf{I}_0\)), cuando el tiempo tiende a infinito (en principio lo estaríamos viendo con solo 50 generaciones) estos estados alélicos estarán vacíos (ninguna población tendrá 1, 2 o 3 alelos A), en nuestro modelo de dos individuos diploides. En cambio, las columnas 1 y 5, que se corresponden a la fijación del alelo a (pérdida del alelo A) y la fijación del alelo A respectivamente plantean una distribución que parece en espejo una de otra; claramente estas columnas se corresponden a las dos barreras absorbentes. Si nos fijamos en la columna 1, el único 0 corresponde a la probabilidad de pasar de 4 alelos A a 0 alelos A. Esto es trivial, ya que si el alelo A se encuentra fijado, al no existir mutación es imposible que las poblaciones evolucionen a otro estado alélico. Inversamente, en la columna 5 el único 0 se corresponde a la probabilidad de pasar de 0 a 4 alelos A. Esto también trivial, ya que no existe posibilidad de pasar del alelo a fijado a otro estado alélico. El resto de las celdas es fácil de explicar, si recordamos las probabilidades de fijación de un alelo dada su frecuencia inicial en la población. Cuando se parte de 1 solo alelo A (i.e., 3 alelos a), la probabilidad de fijación del alelo a es \(\frac{3}{4}\); cuando se parte de 2 alelos A, es de \(\frac{2}{4}=\frac{1}{2}\), y cuando se parte de 3 alelos A (i.e. solo 1 alelo a), la probabilidad de fijación del alelo a es \(\frac{1}{4}\). Lo mismo acontece de forma inversa para las transiciones representadas en la columna 5.

La conclusión de todo lo anterior no es menor: con la matriz de probabilidad de transiciones \(\mathbf{T}\) (??) el estado estacionario (cuando \(t \to \infty\)) implica que solo los estados de fijación de alguno de los alelos tienen probabilidad mayor a cero. El punto de partida solo influirá en la distribución entre ellos, pero no en que solo ellos pueden tener probabilidad positiva de fijación. Pongamos un ejemplo: todas las poblaciones inicialmente tienen 1 alelo A de los 4 posibles (recordar que son dos individuos diploides, \(2N=4\)), es decir, \(\mathbf{I}_0=(0;1;0;0;0)\). Si multiplicamos este vector inicial de probabilidades (probabilidades de encontrar poblaciones del ensemble en ese estado), tenemos que \(\mathbf{I}_0*\mathbf{T}^\infty\) (llamamos \(\mathbf{T}^\infty\) a la potencia infinita, aunque en este contexto \(\mathbf{T}^{50} \sim \mathbf{T}^\infty\)), el resultado es \(\mathbf{I}_0*\mathbf{T}^\infty=(0,75;0;0;0;0,25)\), claramente en línea con lo que esperábamos: ninguna población aún segregando (1, 2 o 3 alelos A), \(75\%\) de la poblaciones con el alelo a fijado y \(25\%\) de las poblaciones con el alelo A fijado.

Si en lugar de haber arrancado con todas las poblaciones con 1 solo alelo A, hubiésemos arrancado con \(25\%\) de las poblaciones con 1 alelo A, \(25\%\) con dos alelos y \(50\%\) con 3 alelos A, entonces \(\mathbf{I}_0=(0;0,25;0,25;0,50;0)\). Por lo tanto \(\mathbf{I}_0*\mathbf{T}^\infty=(0,4375;0;0;0;0,5625)\), es decir que el \(43,75\%\) de las poblaciones de nuestro ensemble tendrían fijado el alelo a y el restante \(56,25\%\) tendría fijado el alelo A.

En general, si la deriva genética es la única fuerza evolutiva actuante (sin selección, sin mutación, sin migración), el equilibrio se alcanza cuando más tarde o más temprano todas las poblaciones se encuentran fijadas para uno de los dos alelos.

Un último punto que cabe mencionar acá. Si observamos la forma en la que crece la suma de los estados correspondientes a las barreras absorbentes, es posible demostrar que a partir de determinado punto la tasa de aproximación al estado de equilibrio es igual a \((1-\frac{1}{2N})\). Dicho de otra forma, a partir de determinado momento, a cada generación la proporción de poblaciones aún segregantes se reduce en \(\frac{1}{2N_e}\), proporción que va a parar de los estados correspondientes a las barreras absorbentes.

3.5 Tamaño efectivo poblacional

Un punto que mencionamos antes pero no abundamos fue la diferencia entre el tamaño censal de una población, es decir el número \(N\) de individuos que la conforman y el tamaño efectivo de la misma, que llamamos \(N_e\). A veces resulta claro cuando en determinadas estructuras poblacionales particulares no tiene ningún sentido el número \(N\) como un indicador del comportamiento genético de la población, por ejemplo cuando un solo macho es responsable de todas las crías, pero otras veces no resulta tan claro. En todo caso, dada la dependencia de varias de nuestras ecuaciones de algún número que represente el tamaño poblacional, es necesario definir qué significa ese número a la luz de las cosas que hemos asumido en nuestros modelos.

Un ejemplo claro lo representa el supuesto de tamaño poblacional constante que hemos usado en el modelo de Wright-Fisher. Desafortunadamente, este supuesto es difícil de constatar en la realidad ya que las poblaciones fluctúan de tamaño, algunas en forma de tendencia (al crecimiento o decrecimiento) y otras a través de ciclos (por ejemplo, tamaños poblacionales de presa y predador, que están íntimamente relacionados). En este sentido, podríamos pensar en obtener un número poblacional en una población perfecta (para nuestro modelo) en la que de alguna manera el efecto genético de la deriva fuese equivalente al de nuestra población real. Si el tamaño poblacional fluctúa en el tiempo, podríamos por ejemplo pensar en que la media aritmética (el clásico promedio, que conoces muy bien) del tamaño censal sería un buen resumen del impacto genético de la deriva en la población. Desafortunadamente, el impacto genético de los tamaños poblacionales pequeños es desproporcionadamente alto, como puede verse en la Figura 3.13.

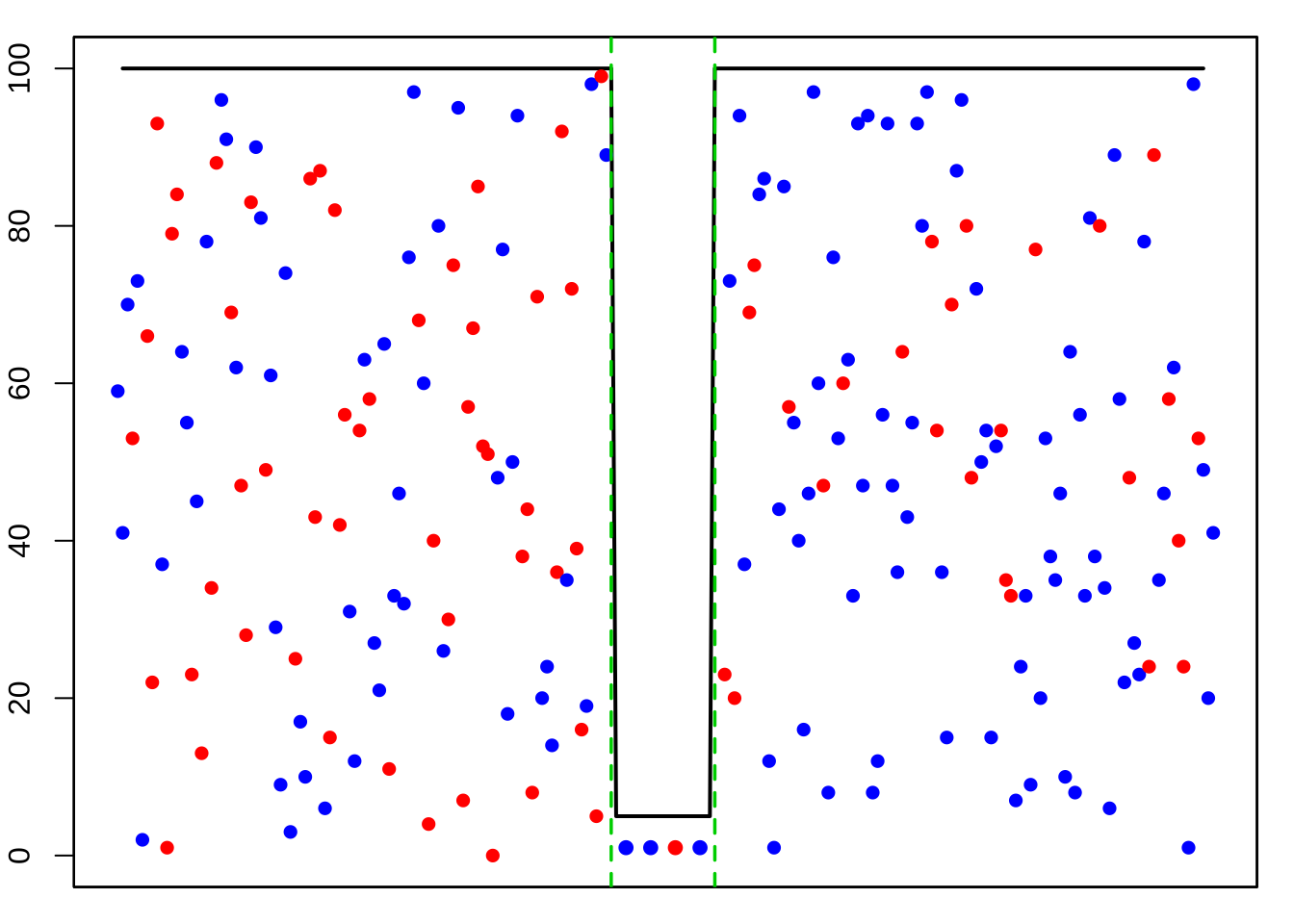

Figura 3.13: Efecto de un cuello de botella poblacional en la frecuencia alélica. La población de 100 alelos, 50 rojos y 50 azules, se ve drásticamente reducida en una generación a 4 alelos (entre las dos líneas verdes), que por muestreo aleatorio son ahora 3 azules y 1 rojo. Luego de ese cuello de botella la población vuelve a expandirse al nivel inicial, pero la frecuencia ya quedó alterada en forma importante (figura propia sobre idea de Hamilton (2009)).

En efecto, pese a que la población inicial era de 50 individuos diploides, o sea 100 alelos, 50 rojos y 50 azules, al sufrir un cuello de botella poblacional (sobreviven 2 individuos diploides, marcado por las dos líneas verdes en la Figura 3.13) se muestrean 3 alelos azules y 1 rojo (un evento que tiene una probabilidad de \(\frac{1}{4}=25\%\)). Al expandirse nuevamente la población a 50 individuos, es decir 100 alelos, lo hará desde la frecuencia del cuello de botella. Resulta clara la influencia desproporcionada (respecto a un promedio simple) que tiene el muestreo durante el cuello de botella poblacional.

Veamos entonces una forma más razonable de estimar el tamaño de una población que fluctúa en número. Para hacer nuestro razonamiento supongamos que la población va de la generación 0 hasta la 2. De acuerdo a lo que vimos en la sección de Homocigosidad y Heterocigosidad,

\[\begin{equation} 1-F_2=\left(1-\frac{1}{2N_1}\right)(1-F_1) \tag{3.14} \end{equation}\]

\[\begin{equation} 1-F_1=\left(1-\frac{1}{2N_0}\right)(1-F_0) \tag{3.15} \end{equation}\]

Sustituyendo (3.15) en (3.14), tenemos:

\[\begin{equation} 1-F_2=\left(1-\frac{1}{2N_1}\right)\left(1-\frac{1}{2N_0}\right)(1-F_0) \tag{3.16} \end{equation}\]

Si el tamaño \(N\) fuese constante, obtendríamos el \(N_e\) generalizando esta expresión para un tiempo \(t\)

\[\begin{equation} 1-F_t = (1-\frac{1}{2N_e})^{t}(1-F_0) \tag{3.17} \end{equation}\]

Por ejemplo, en el caso en que \(t=2\), la ecuación (3.17) se transforma en

\[\begin{equation} 1-F_2=(1-\frac{1}{2N_e})^2 (1-F_0) \tag{3.18} \end{equation}\]

Ahora, si igualamos el resultado “real” (ecuación (3.16)) a la “ideal” (ecuación (3.18)), tenemos:

\[\begin{equation} \begin{split} 1-F_2=(1-\frac{1}{2N_e})^2(1-F_0)=(1-\frac{1}{2N_1})(1-\frac{1}{2N_0})(1-F_0)=1-F_2 \\ (1-\frac{1}{2N_e})^2=(1-\frac{1}{2N_1})(1-\frac{1}{2N_0}) \end{split} \tag{3.19} \end{equation}\]

Desarrollando la ecuación (3.19), tenemos que: